Xeon-verés: elrajtolt az új AMD Epyc

Hivatalosan is bemutatta második generációs, Rome kódnevű Epyc szerverprocesszorait az AMD. Bár a chiptervező már hónapokkal ezelőtt ismertette a fejlesztés egyes technikai jellemzőit, valamint hetek óta szállítja kiemelt partnereinek a CPU-kat, a szélesebb körű piaci rajtra egészen tegnapig kellett várni. Az AMD szerint az új kiszolgálós processzorok jelentős előnyben vannak a konkurens Intel termékeivel szemben, amelyre legutóbb a 2000-es évek első felében volt példa. Technikai előnyét meglovagolva a tervezőcég akár vissza is szerezheti az elmúlt másfél évtizedben eltékozolt 25 százalékos részesedését, amely rendkívül rosszul érintené az Intelt.

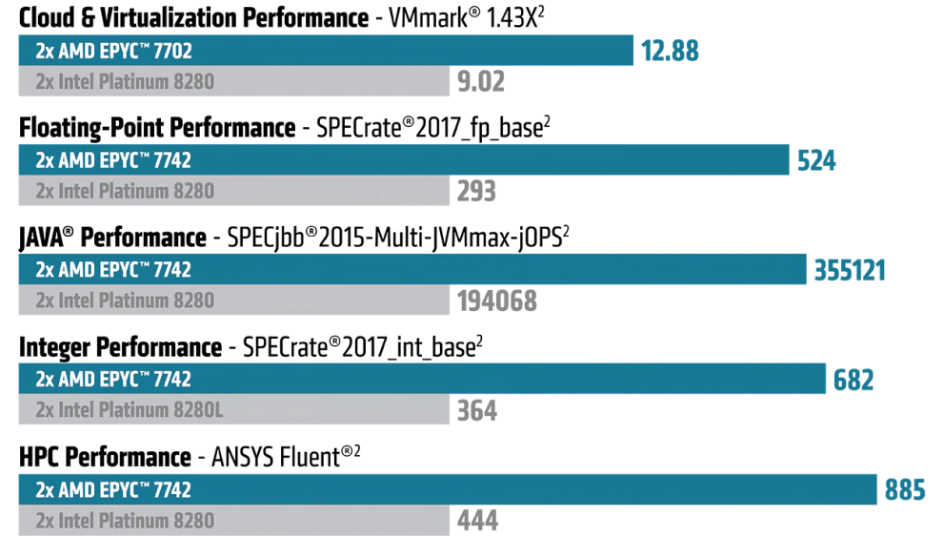

Sűrűségben akár kétszeres is lehet az új Epyc előnye, hasonló számítási teljesítményt alapul véve pedig az új processzorok közel fele disszipáció mellett működnek - állítja az AMD. Mindezek tetejébe a termékek árazása kifejezetten baráti (a Xeonokhoz viszonyítva), a csúcsmodell közel féláron kínál több mint kétszeres magszámot az Intelhez mérten. A processzorok versenyképességét bizonyítja, hogy az ismert szervergyártók (élükön a HPE-vel és a Lenovóval) már javában készülnek az új Epyc-re alapozó rendszerekkel, a különféle modellek száma pedig jelentősen meghaladja az első generációnál látottakat. A nagy felhőszolgáltatók sem hagyják ki a lehetőséget, a Microsoft Azure és a Google Cloud egyaránt kínál majd Epyc "Rome" instance-eket, a Google pedig még belső infrastruktúrájában is beveti az AMD újdonságait.

Külön utakon

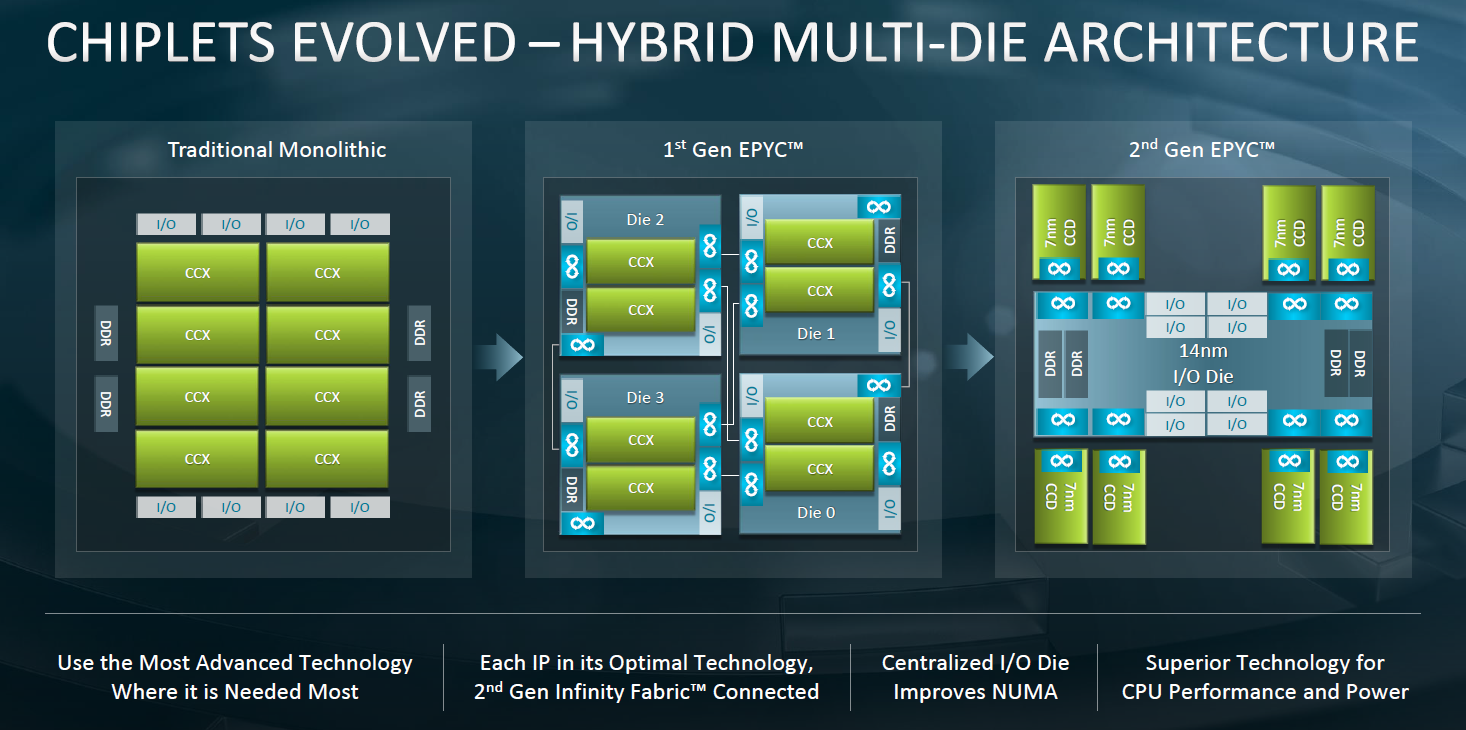

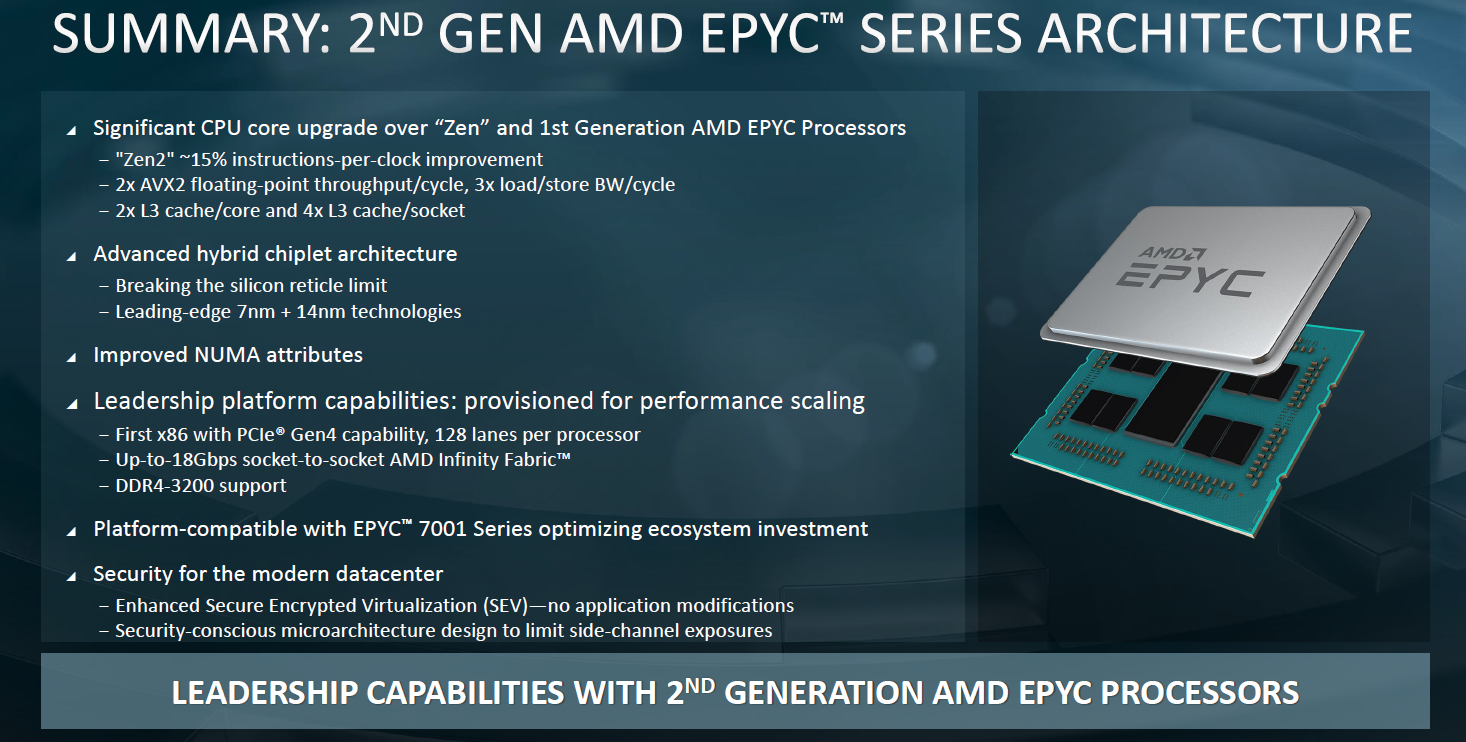

A második generációs Epyc processzorok versenyképessége a chiptervező relatíve sajátságos fejlesztési irányának köszönhető. Az asztali Ryzen 3000-es "Matisse" processzorokhoz hasonlóan a "Rome" kódnevű szériához is két eltérő funkcionalitású lapkát tervezett a cég, melyek együtteséből áll össze a komplett, működképes processzor. Az alapot a már bejáratott, jó kihozatallal és viszonylag alacsony költségek mellett elérhető 14 nanométeres technológián készülő IO chip (~északi híd) adja. Ebbe a csíkszélesség szempontjából kevésbé kritikus egységek kerültek, így a lapka tartalmazza a nyolccsatornás DDR4 memóriavezérlőt, a 128 darab Gen4 PCI Express sávot, illetve a további különféle integrált vezérlőket, például a SATA-t vagy az USB-t.

A nagy (300+ mm2) chip további fontos szerepe, hogy a csillag topológiának megfelelően HUB-ként összefogja és kiszolgálja a hozzá kapcsolt, Zen 2 processzormagokat tartalmazó, apró lapkákat. Ehhez készült az Infinity Fabric interkonnekt második iterációja, amely a korábbi több mint duplájára, másodpercenként 42,67-ről 100 GB/s-ra emeli a kétirányú adatkapcsolat tempóját, így az egyes lapkák közti sávszélesség már kevésbé jelent szűk keresztmetszetet az adatcserében. Az AMD ezzel lényegében úgy választotta szét a még 2000-es évek elején épp a cég által összegyúrt CPU és vezérlőhíd feladatait, hogy utóbbi a tokozáson belül maradt. Szigorúan a szilícium szintjén nézve a Rome processzorok nem rendelkeznek integrált memóriavezérlővel.

8 erős érv a friss AI Engineering alapjai képzésünk mellett Összefoglaltuk röviden, hogy miért érdemes részt venni a május 26-án induló online tanfolyamon.

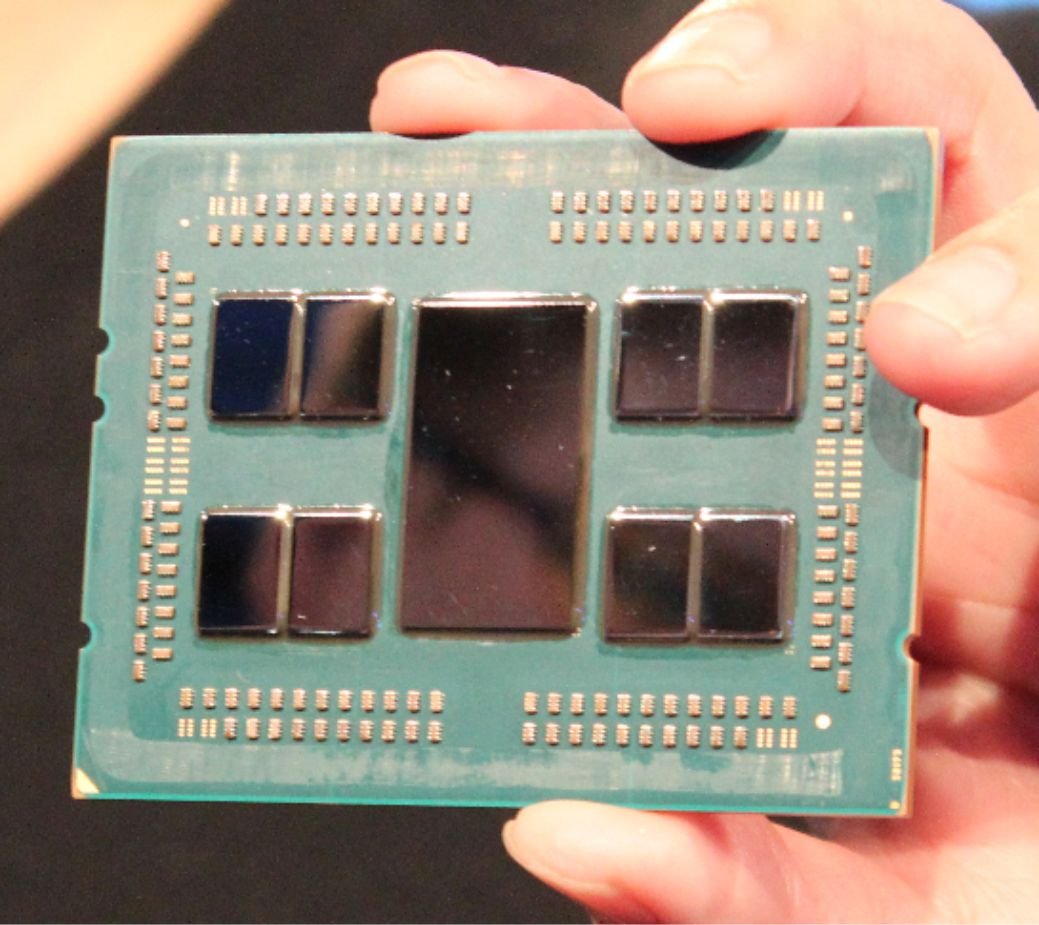

A nagy I/O chiphez legfeljebb 8 darab, szigorúan csak a végrehajtóegységeket és gyorsítótárakat (és egy Infinity Fabric kontrollert) felvonultató, nyolcmagos CCX (Core Complex) lapka kapcsolódhat. A Zen 2-es magokat tartalmazó szilícium a piac egyik élvonalbeli, 7 nanométeres (TSMC) technológiájával készül, területe pedig nagyjából csupán 80 mm2. Ez rendkívül alacsony, alulról súrolja a felsőkategóriás okostelefonos alkalmazásprocesszorok értékét. Az AMD saját mérései szerint a Zen 2-es magok egyszálas terhelésnél 15, többszálasnál pedig 23 százalékos IPC gyorsulást (tehát azonos órajelet alapul véve) produkálnak az Zen első generációjához képest.

Az AMD multi-chip (vagy multi-die) megoldását elsősorban a termelés gazdaságossági szempontjai mozgatták, másodlagosan pedig a felépítés biztosította rugalmasság és a tervezési ciklus alacsonyabb kockázata. Ezáltal a költséges 7 nanométeres gyártási eljárást nem pazarolják el olyan, kevésbé igényes áramköröket tartalmazó szilíciumterületre, mint amilyen a memória- és az egyszerű I/O-vezérlők, miközben miniatürizálásukat korlátozza a rengeteg huzalozás, a költségek csökkentését pedig a relatív drága tokozás - vagyis sem a 7 nanométeres eljárás teljesítménybeli-, sem pedig méret- és költségbeli előnyeit nem igazán lehetne megfelelően kamatoztatni.

Ily módon a jelenlegi csúcsot képviselő 7 nanométeres eljárást kizárólag a műszakilag és üzletileg legértékesebb áramkörök kapják meg. Ezzel minimalizálható a selejt hányad, amely a termelés gyorsabb felfuttatását eredményezi, miközben a különféle vezérlőfunkciók I/O chipre történő átmozgatásával a 14 nanométeres gyártástechnológia folyamatos kihasználtsága is biztosítva lehet. (Utóbbi azért is fontos az AMD számára, mert 2021 végéig érvényes szerződése van a GlobalFoundries kapacitására.) A többlapkás, multi-chip felépítés hátránya most is a hosszabb vezetékek miatti megnövekedett késleltetés lehet, amelyre rájön még a költségesebb tokozás, hisz az egyes lapkákat a nyomtatott áramkörbe ágyazott huzalozással kell összekötni.

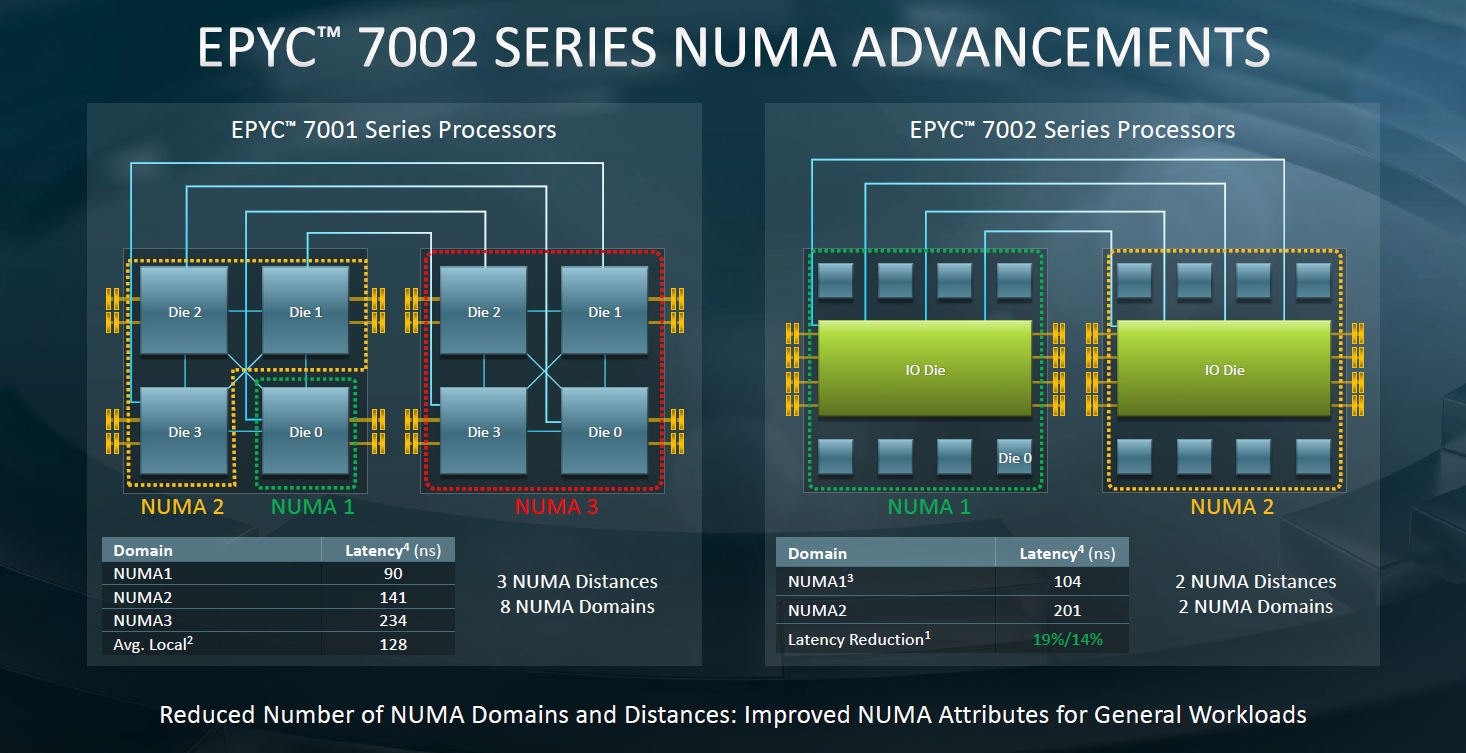

A Rome kódnevű processzorok felépítése nem csak a komplett piacon, de az AMD-n belül is újnak számít. Az első generációs Epyc négy egyenrangú és teljes értékű lapkából épült fel, amely jelentősen megbonyolította a rendszer memóriakezelését. Az optimális működéshez összesen 4 darab NUMA (non-uniform memory access) domaint kellett jól kezelni, amely több esetben extra munkát jelentett az adminisztrátorok számára. A második generációs Epyc processzoroknál lényegesen egyszerűbb a helyzet, 4 helyett ugyanis már csak 1 NUMA domaint számol (egyprocesszoros rendszert alapul véve), melynek hála átlagosan 14-19 százalékkal csökkent a rendszermemória késleltetése, de ami ennél is fontosabb, hogy már nincs szükség speciális optimalizációkra.

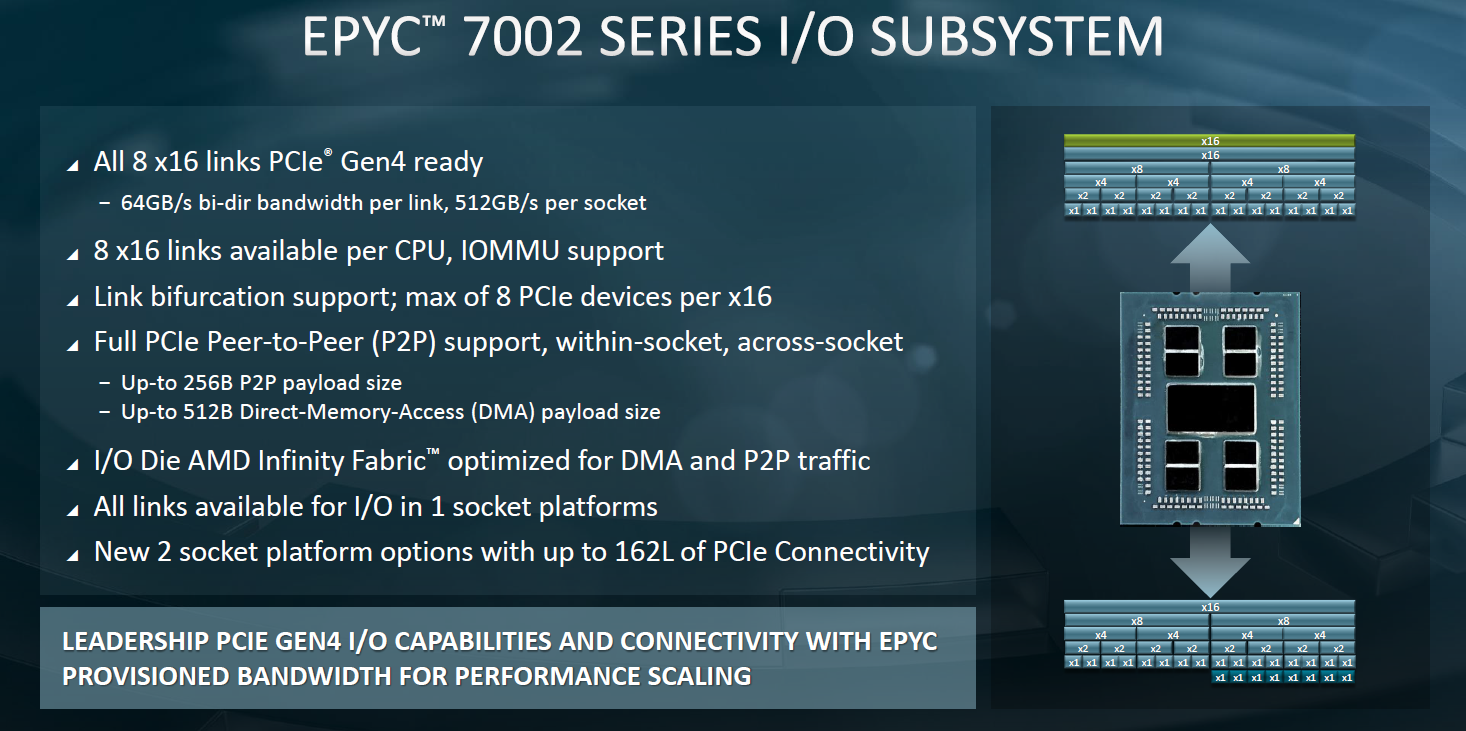

A Rome másik, szerveres környezetben rendkívül hasznos tulajdonsága a PCI Express 4.0 támogatása. A PC-kkel ellentétben a kiszolgálóknál sokkal könnyebb lesz profitálni a Gen4 nyújtotta dupla sávszélességből, legyen szó gyorsítókártyákról, több portos 100GbE hálózati adapterekről, vagy épp NVMe SSD-kről. A vonalankénti dupla sávszélességnek hála egységnyi PCI Express sávra akár kétszer több SSD is ültethető, miközben a gazdavezérlő és a meghajtó közötti sávszélesség a 3.0-s rendszerhez képest változatlan marad. Ez azért fontos, mert így viszonylag alacsony felár mellett emelhető az SSD-k száma, miközben az alaplap és a processzor komplexitása nem nő jelentősen. Természetesen ezt a másik oldalról is meg lehet ülni, egységnyi sávot alapul véve duplázható a sávszélesség, ami egyes, teljesítményre kihegyezett rendszerek (pl. csúcskategóriás tárolórendszerek) esetében jöhet kapóra. A Rome kódnevű processzorok egységesen 128 darab PCI Express sávot kínálnak, a szám viszont kétprocesszoros kiépítésnél nem duplázódik, mivel az egyes tokozások összekapcsolásához (is) alkalmazott Infinity Fabric a PCIe sávok huzalozását használja. Ennek fényében az OEM-ek dönthetnek arról, hogy a vonalak száma, vagy a CPU-k közötti összeköttetés sávszélessége a fontosabb az adott kétutas terméknél, mely lehetőséggel 162 darbra emelhetőek a szabadon felhasználható PCIe sávok.

A PCI Express mellett rendszermemóriában is az új Epyc processzorok vannak előnyben. Modelltől függően foglalatonként legfeljebb 4 terabájt DDR4-3200 memória támogatott, amely elméletben 200 GB/s feletti sávszélességet jelent processzoronként. Ezzel szemben az Intel aktuális Xeon generációja alapértelmezetten 1-1,5 terabájt memóriát támogat, felárért cserébe pedig 2 és 4,5 terabájtos modellek is elérhetőek. Sávszélességben is hátrányban van az Intel, a hatcsatornás DDR4-2933 támogatással ugyanis CPU-nként 141 GB/s érhető el, bár a teljes képhez hozzátartozik, hogy a maximális magszámot alapul véve az Intelnél az előny a kevesebb, legfeljebb 28 mag miatt (Intel: 5 GB/s per mag, AMD: 3,2 GB/s per mag).

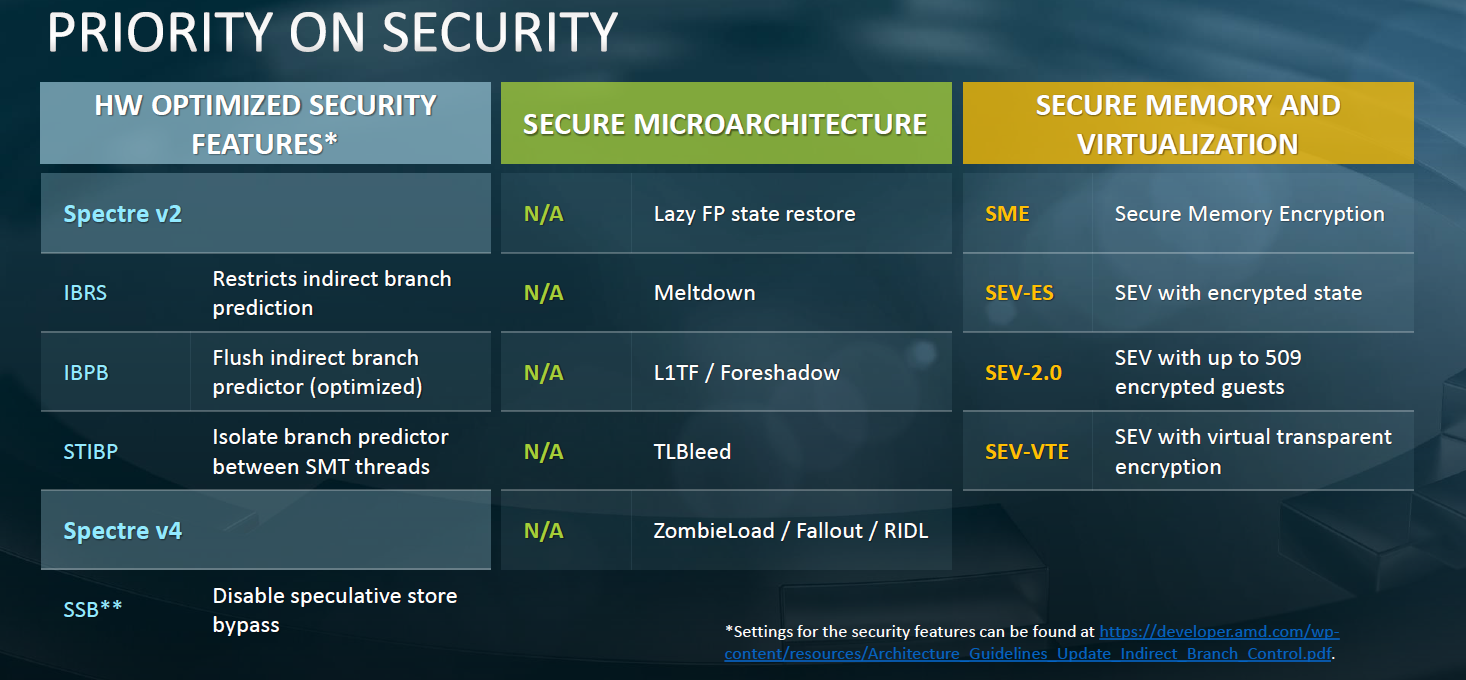

Az elmúlt lassan két év biztonsági hibái után az ezzel kapcsolatos fejlesztéseket is vastagon aláhúzta az AMD. Az SEV (Secure Encrypted Virtualization) már az előző generációból is ismerős lehet. Ezt kihasználva a rendszer képes titkosítani a memória tartalmát, amivel a VM és a hypervisor, illetve az egyes VM-ek és a konténerek saját memóriaterülete is biztonságosan elszeparálható egymástól, útját állva az esetleges támadásoknak több bérlős környezetben, például egy felhős infrastruktúra esetében, fizikai szerverenként akár 509 VM-ig. A titkosítani kívánt memórialapokat az operációs rendszer és a hypervisor tudja kiválasztani, a DMA motoron keresztül pedig biztosítható, hogy az egyes rendszerben lévő eszközök (pl. háttértár, hálózati csatoló) hozzáférhessenek a szükséges részekhez. Az SEV az AMD-V része, a DRAM szintű titkosítást pedig egy az MMU-ba épített AES-128 motor végzi, azaz a processzormagokra többletterhelés nem hárul.

A konkurens Intel termékeiben rendre felbukkanó újabb sebezhetőségek miatt az AMD természetesen kiemeli, hogy Zen 2 minden eddig ismert, a spekulatív végrehajtásra alapozó támadás ellen védett, beleértve az összes Spectre, ZombieLand, Fallout, illetve hasonló mutáns réseket.

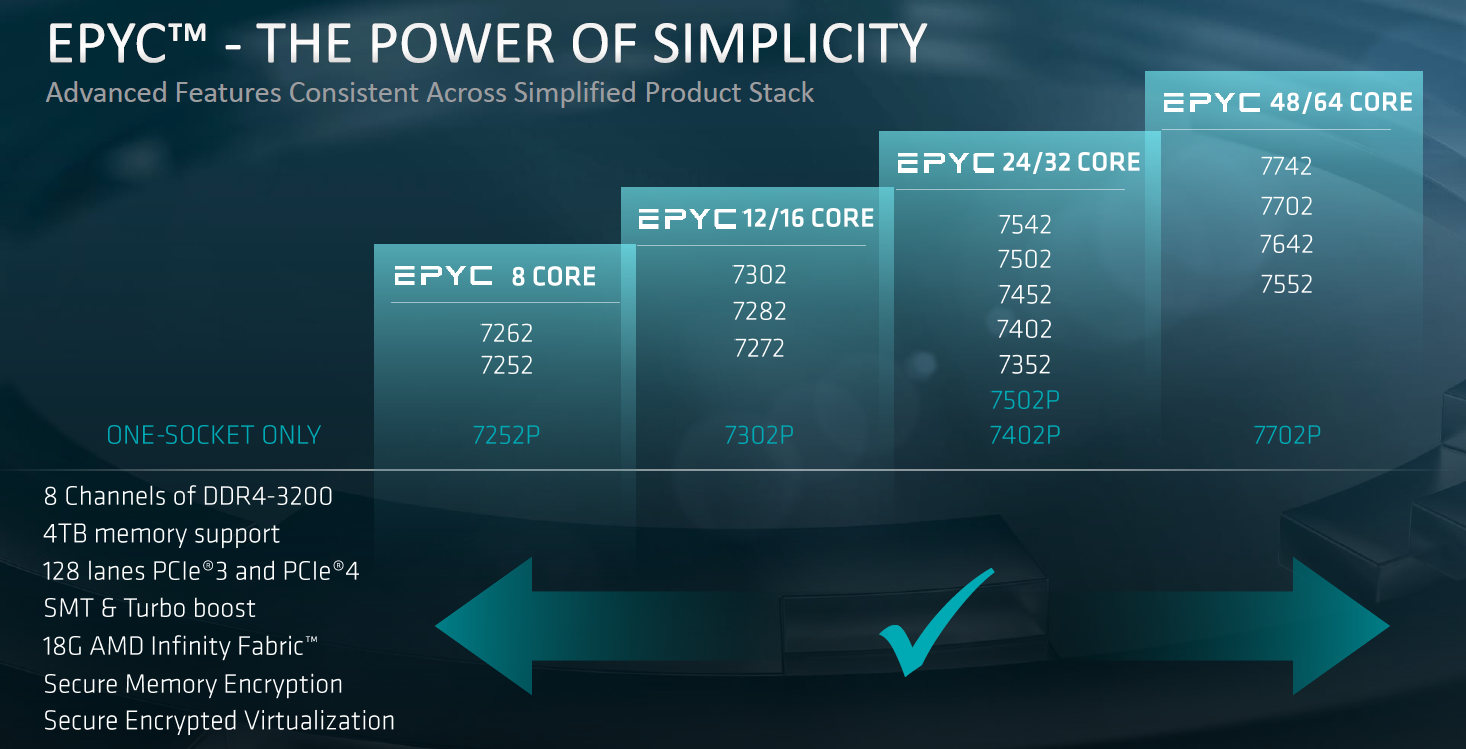

19 új processzormodell

A második generációs Epyc családot összesen 19 modellel rúgta be az AMD, melyek közül 14 darab kétutas, 5 darab pedig kifejezetten egyutas szerverekhez készült. Érdekes, hogy az AMD a Rome termékeket is a 7000-es szériába pakolta, így a generációt jelző (2-es) számot rendhagyó módon a típusszám végén kell keresni. A tervezőcég továbbra sem szegmentálja túlságosan palettáját, az egyes modellek között a magszám, az órajel, illetve a TDP, valamint a már említett egy- vagy kétutas kiépítési lehetőség jelenti a különbséget. Ennek megfelelően kettő darab hatvannégymagos, két negyvenyolncmagos, három harminckétmagos, két huszonnégymagos, két tizenhatmagos, egy tizenkétmagos, valamint két nyolcmagos modellt vonultat fel a 2P-s kínálat. Az egyprocesszoros "P" jelölésű termékek kínálata lényegesen egyszerűbb, hisz itt mindegyik magfokozat csak egy modellt tartalmaz, miközben a negyvenyolncmagos és a tizenkétmagos opció kimaradt.

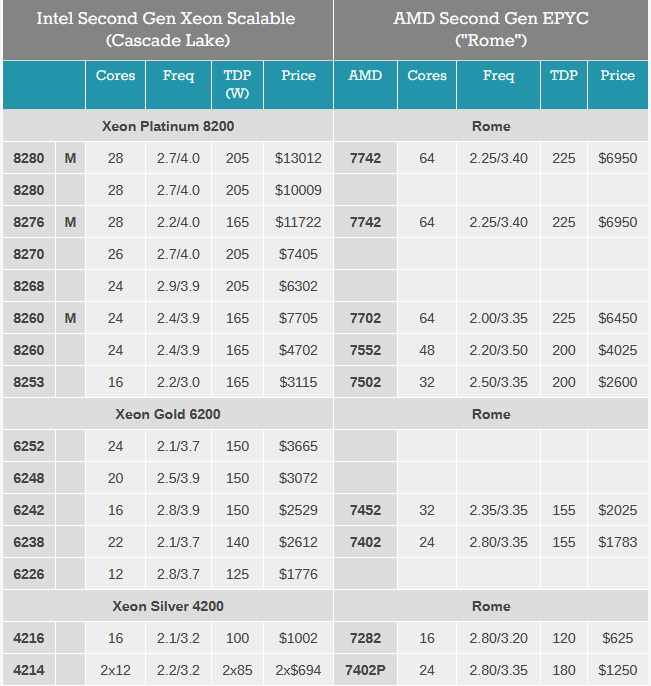

Az abszolút csúcsmodellt a kétutas Epyc 7742 képviseli, amely 64 darab processzormagot és 128 végrehajtószálat kínál 2,25 GHz-es alapórajel, illetve 3,4 GHz-es turbó frekvencia mellett. Mindehhez összesen 256 megabájt (nem egybefüggő) L3 cache, valamint 225 wattos TDP társul. Az AMD ezért listaáron nettó 6950 dollárt kér, amely ugyan a cég valaha bemutatott legdrágább processzorát jelenti, az versenytárs Intelhez képest ez még mindig olcsónak számít.

forrás: AnandTech

Az Intel térfeléről ugyanis a huszonnyolcmagos, vagyis kevesebb mint fele annyi magot kínáló "Cascade Lake" Xeon Platinum 8280M-ért nettó 13 012 dollárt kér a chipgyártó, ami a csúcsmodell Epyc árcédulájának közel duplája. A termék a magasabb órajeleknek (2,7/4 GHz) köszönhetően néhány szálon ugyan még gyorsabb lehet, az összes magot terhelve (pl. HPC-s vagy felhős környezetben) azonban borítékolható az Epyc előnye. Mindeközben egyetlen magra lebontva sokkal kedvezőbb lehet az AMD fogyasztása, hisz míg a Platinum 8280M huszonnyolcmag mellett maximum 205 wattot disszipálhat (7,3 watt/mag), addig az Epyc 7742 64 mag mellett ennél csak alig 10 százalékkal kér többet (3,5 watt/mag), hála a 7 nanométeres technológiával gyártott Zen 2 lapkáknak.

forrás: AMD

A palettán lejjebb csúszva is megvan a tetemes különbség. A harminckétmagos EPYC 7502-t mindössze nettó 2600 dollárért kínálja az AMD, miközben közel ugyanennyiért tizenhatmagos Xeon Gold 6242-t lehet kapni. A processzor ára ugyanakkor továbbra sem játszik döntő szerepet a nagy adatközpontos beruházásokban. Az AMD viszont a Zen 2-nek hála már a magonkénti teljesítményben sincs hátrányba, így a bizonyos esetekben tetemes kiadást jelentő esetlegesen nagyobb licencköltségek sem szólnak az Epyc processzorok ellen. Sőt, a chiptervező szerint az egyutas modelleknek hála előnyben lehetnek olyan esetekben, amikor a licencelés alapját még a foglaltok száma adja. Az AMD ilyen irányú erőfeszítései látva egyébként már az Intel is kínál kifejezetten egyfoglalatos rendszerekbe szánt termékeket. Az "U" jelölésű Xeonokat még áprilisban jelentette be a cég.

Jelentősen alacsonyabb költségek

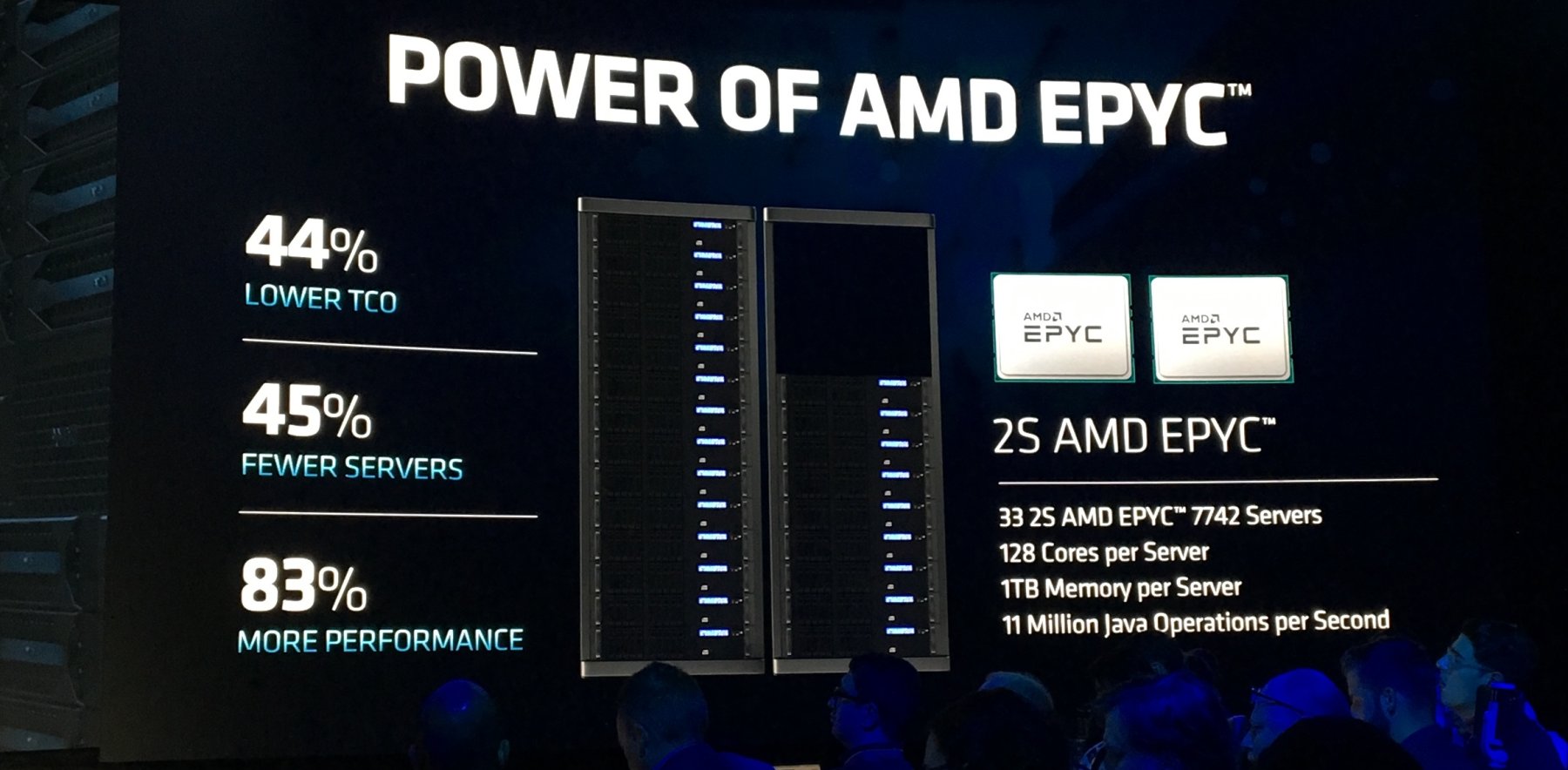

Az AMD számára ugyanakkor minden bizonnyal elsősorban a sűrűség, illetve az ezzel összefüggő, akár 44 százalékkal alacsonyabb birtoklási összköltség (TCO) hozhatja meg a régóta áhított nagy piaci előrelépést. A tervezőcég prezentációja szerint a második generációs Epyc processzorokkal 45 százalékkal növelhető az egységnyi rackbe installálható magszám, tehát változatlan hely- és energiaigény, illetve ezzel együtt hűtés mellett érhető el jelentős bővítés, vagy igény szerint épp megtakarítás. Erre pedig garantáltan ráharapnak a nagy felhőszolgáltatók, amelyeknek a darabonként akár 10 000 dolláros processzoráraknál sokkal nagyobb fejfájást jelent a nem egyszer több 10 000 darabos telepítések megfelelő elhelyezése, illetve az energiahatékonyság. A felhős környezetekben ugyanis a teljes birtoklási költség jelentős részét teszi ki az áramfogyasztás, ellentétben a vállalati szerverekkel, ahol a TCO-t jobbára a szoftverköltségek és projektköltségek (pl. tanácsadási díjak) dominálják.

A Google egyik korábbi nyilatkozata szerint már 20 százalékkal kedvezőbb költség/teljesítmény mutatóért váltanának egy kedvezőbb paramétereket kínáló platformra, akár csak egyetlen generáció erejéig. Ennek tükrében nem csoda, hogy a vállalat az elsők között dicsekedett el azzal, hogy nem csak publikus felhőszolgáltatásában, de már belső infrastruktúrájában is működnek második generációs Epyc szerverek. A Google az AMD megoldásaira építve a valaha kínált legnagyobb általános célú VM-eken dolgozik, példányonként akár 200 vCPU-val. A szolgáltató szerint határozott ár/teljesítmény ugrást mutat majd az új platform, amelyhez akár 60 százalékkal magasabb memória-sávszélesség társulhat, valamikor az év hátrelévő részében. A Google mellett a Twitter volt a másik nagyobb early adopter. A közösségi oldal üzemeltetői szerint a második generációs Epyc telepítésének hála 25 százalékkal csökkent a TCO, amely bár elmarad az AMD által közölt ideális értéktől, a Google 20 százalékos küszöbét már meghaladja.

Rome wasn't built in a day

Az jóformán már nem kétséges, hogy az AMD piacot szerez-e a második generációs Epyc processzorokkal, csupán annak üteme lehet kérdéses. Mindez ugyanakkor még nem jelent hirtelen fordulatot, az adatközpontos fejlesztések ugyanis hosszú hónapokat vehetnek igénybe, arról nem beszélve, hogy az AMD képes lesz-e megfelelő ütemben kiszolgálni az estlegesen megugró igényeket. Az Opteronok fénykorában bő két évre volt szükség, hogy közel nulláról 20-25 százalékra tornássza fel szerverpiaci részesedését a cég. Becslések szerint jelenleg 5 százalék körül állhat az AMD, a korábbi rekord beállításához tehát most is szükség lenne még nagyjából másfél-két igazán versenyképes évre. Nem véletlen, hogy az AMD rendkívül bőkezű a szegmentálással és az árazással, amelyek nélkül lényegesen nehezebben tudna piacot szerezni.

Mindeközben persze az Intel sem ül a babérjain. Bár a vállalat a 10 nanométeres problémák miatt jelenleg egyértelmű technológiai hátrányt szenved, a vezetés asztalán már régóta terítéken van az AMD térnyerésének lassítása. Brian Krzanich, a chipgyártó korábbi elnök-vezérigazgatója még tavaly júniusi távozása előtt leszögezte, nem szabad hagyni, hogy konkurensük 15-20 százaléknál magasabb szeletett hasítson ki a nagy profittal kecsegtető szerverpiacból. Versenyképesebb termék híján pár hónapig csak az árazással és jól kiépített partnerkapcsolataival sakkozhat az Intel, amely egyes vásárlóinak a listaárnál lényegesen olcsóbb adhatja a Xeonokat, így gáncsolva az AMD térnyerését. Ez azonban a forgalomban és a profitban egyaránt visszaüthet, bár a legutóbbi pénzügyi jelentés még 2 százalékkal magasabb átlagos eladási árról beszélt 12 százalékkal kevesebb darabszám mellett.

2nd Gen AMD EPYC™ Launch Recap

Még több videóÚj termékek formájában már csak jövőre tud választ adni az Intel, amely az 56 magig skálázódó Cooper Lake szerverprocesszorokat valamikor a jövő év első negyedévében, a 10 nanométeres "Ice Lake" Xeonokat pedig nem sokkal ezt követően tervezi piacra dobni. Pár hónapig tehát az eddigieknél lényegesen könnyebb lesz az AMD helyzete, amely ugyancsak dolgozik az utódon. A Milan kódnevű, már végleges formában lévő Zen 3 magos processzorok megjelenéséről egyelőre nincs pontos információ, a szokásos menetrend szerint azonban jó eséllyel valamikor 2020 második felében érkezhetnek meg a harmadik generációs Epyc termékek.