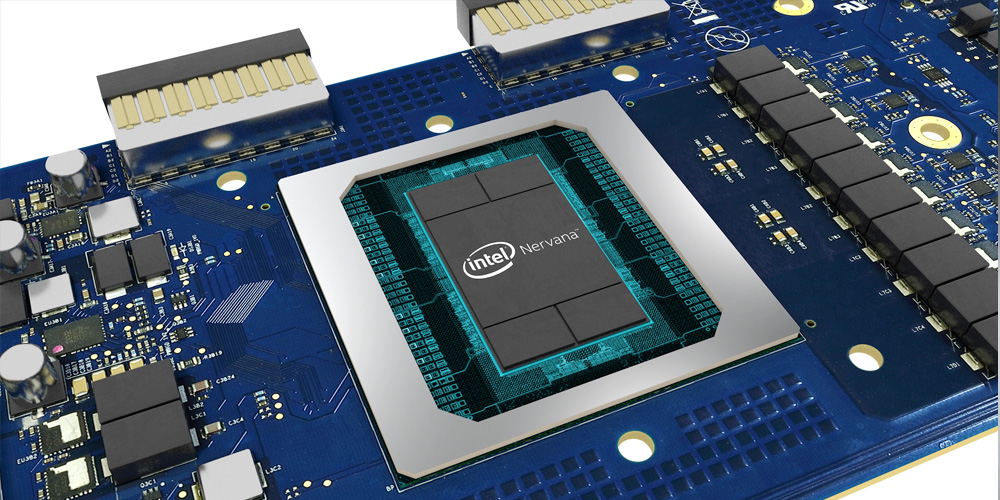

Küszöbön az Intel első AI gyorsítója

A chipgyártó a bő egy éve felvásárolt Nervana technológiájával jelentkezik az év végén.

Bejelentette első AI gyorsítóját az Intel, az NNP (Neural Network Processor) a tavaly augusztusban felvásárolt Nervana technológiáját testesíti meg, azzal a chipgyártó a különféle gépi tanulásos műveleteket szeretné gyorsítani. A vállalat ehhez néhány más vállalathoz (pl. Fujitsu) hasonlóan egy ASIC-ot, azaz alkalmazás specifikus áramkört tervezett, amely az ígéret szerint forradalmasítja az AI számítások végrehajtását. A gyorsítót a Facebook bevonásával készíti az Intel, az első példányokat pedig még az év vége előtt leszállítaná.

Az első NNP mélyebb technikai részleteit nem tárta fel az Intel, egyelőre csupán néhány kissé homályos információ került felszínre. Utóbbi alapján az architektúra nem rendelkezik a különféle processzorokra jellemező, sztenderd gyorsítótár hierarchiával, a chipben található memóriákat szoftveresen lehet menedzselni. Az ígéret szerint az ebből eredő rugalmassággal eltérő kódok esetén is ki lehet aknázni az NNP kvázi maximális számítási kapacitását. Ugyancsak érdekesen hangzik a flexpoint nevű fejlesztés, amely egy új, hatékonyabb numerikus formátumot takar, amivel az Intel szerint a skaláros számítások fixpontos műveletekként implementálhatóak. Ennek előnye, hogy az utóbbiakhoz szükséges végrehajtó áramkörök kisebbek, ezzel pedig fogyasztásuk alacsonyabb. Ennek ugyanakkor hátulütője is lehet, a megközelítés limitálhatja a szoftveres oldal rugalmasságát.

8 erős érv a friss AI Engineering alapjai képzésünk mellett Összefoglaltuk röviden, hogy miért érdemes részt venni a május 26-án induló online tanfolyamon.

Az egyelőre nagy kérdés, hogy az Intel mindezzel mennyire tud majd labdába rúgni. A legutóbbi ígéret szerint a Nervana tízszer jobb hatékonyságot ígért az Nvidia Maxwell-alapú Tesla gyorsítóinál, ám azóta a konkurens két lépést is tett, a nyár elején bemutatott Voltát pedig már kifejezetten AI gyorsításra hegyezte ki. Ezzel a Pascal-alapú megoldásnál tréningben tizenkétszer, következtetési (inferencing) műveleteknél pedig hatszor magasabb tempóra képes az újdonság, miközben a fogyasztás nem változott számottevően, tehát az Intelnek várhatóan nem lesz könnyű dolga egy lépésben legyőzni a konkurenciát.

Emellett nem az Intel az első, amely dedikált gyorsítót készít gépi tanuláshoz. A Google ehhez már két éve használ saját megoldást, a TensorFlow gépi tanulásos algoritmusok gyorsításához tervezett TPU egy mátrixokkal dolgozó CISC processzor, amely a cég mérései szerint 35-ször gyorsabb az Intel korábbi csúcs Xeonjánál, miközben fogyasztása alacsonyabb, tehát a kritikus fontosságú fogyasztás/teljesítmény mutató is számottevően jobb, mint CPU (vagy akár GPU) esetében. Néhány hónapja pedig a Fujitsu is bejelentette saját fejlesztését, a DLU (Deep Learning Unit) néven futó projekt első manifesztációja az elvárások szerint tízszer hatékonyabb lesz a konkurensek megoldásainál.

Intel: az AI vonatát már nem késsük le!

Az Intel még tavaly kezdett kvázi pánikszerűen felvásárolni AI-os kompetenciával rendelkező cégeket. A vállalat augusztusban jelentette be a deep learning gyorsítás terén élen járó Nervana Systems akvirálását, majd pedig a kognitív technológiákban utazó Saffront is bekebelezte. A gyártó ezek mellett más felvásárlásokat is eszközölt az elmúlt bő egy évben. Ugyancsak tavaly szeptember elején érkezett a bejelentés, hogy a Movidiust is az Intelhez kerül, erősítve a cég gépi látásos kompetenciáját. Az akvirált vállalat igazi nagyágyúnak számít(ott), többek között a Google térbeli képrögzítést célzó Project Tango technológiája mögött is a Movidius áll. Emellett a cég olyan partnerekkel dolgozott együtt, mint a Lenovo, vagy a drónjairól megismert DJI vagy a FLIR, amelynek hőkameráját a CAT okostelefonjában magunk is kipróbáltuk.