A ray tracing és a gépi tanulás körül forog az Nvidia

Friss fejlesztéseiről beszélt márciusi nagy GTC (GPU Tech Conference) rendezvényén az Nvidia. Ahogy az elmúlt években, úgy most is inkább a nagyvállalati és üzleti megoldásokon volt a nagyobb hangsúly, azon piacokat érintve, ahol az Nvidia számára még bőven akad növekedési potenciál. Természetesen a játékosokat, illetve az azokhoz kapcsolódó termékekről sem feledkezett meg a tervezőcég, amely színtéren újfent ray tracingé volt a főszerep.

A rendezvényhez köthető egyik hír a GeForce-okat érinti. Az Nvidia ugyanis bejelentette, hogy egyes korábbi termékei is megkapják a DirectX Raytracing (DXR) támogatást, melynek hála (bizonyos minőség és sebesség mellett) akár a Pascal kártyákkal is elérhető lesz a sugárkövetéssel megfűszerezett grafika. Mindez a Microsoft API implementációjának köszönhető, amely a beépített fallback rétegnek hála lehetőséget biztosít a natív támogatás nélküli GPU-kon való futtatására compute shaderen keresztül. A ray tracinghez szükséges számítások így a CUDA magokon futnak egyszeres pontosságú lebegőpontos és/vagy egészszámos műveletek formájában, a hardvertől függően.

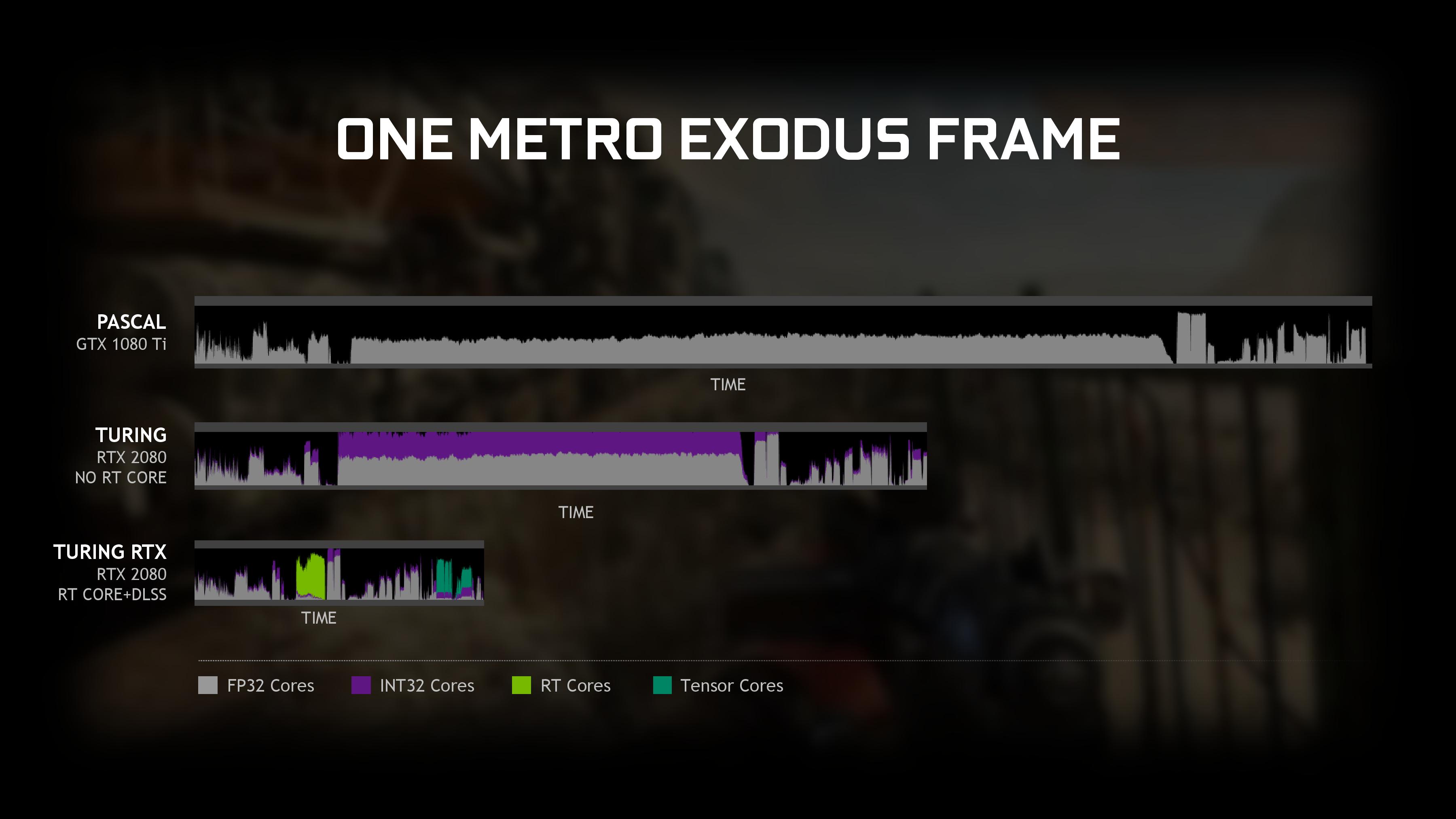

A támogatást a GeForce 1000-es (Pascal) és GeForce 1600-as (Turing GTX) sorozat kapja meg, előbbi esetében GTX 1060 6GB-os termékektől kezdődően. Míg a Pascal GPU-kból architektúra szintjén maradtak ki a ray tracing műveletek gyorsítására hivatott RT magok, addig a GeForce GTX 1660 kártyák alapját adó Turing TU116 GPU-ból az Nvidia még a tervezőasztalon "vágta ki" a végrehajtóegységeket. Ennek ellenére a Turingnak várhatóan jobban fekszik majd a ray tracing, a grafikus architektúra ugyanis natívan támogatja az egyszeres pontosságú egészszámos (INT32) és lebegőpontos (FP32) műveletek párhuzamos végrehajtását, bár ez még messze nem kompenzálja az RT magok hiányát.

Még pár hetet várni kell, hogy kiderüljön, pontosan mire képesek DirectX Raytracing mellett a GTX kártyák, de az Nvidia erre vonatkozó diája alapján nem érdemes csodát várni. Ez különösen a Pascal GPU-kra igaz, ahol a GTX 1080 Ti és az RTX 2080 viszonylatában körülbelül negyede lehet a frame time utóbbi kártya javára. Tekintve, hogy az RTX 2080-at is meg tudja izzasztani magas minőség mellett néhány erősebb ray tracing effekt, a Pascal-alapú kártyáknál leginkább csak ízelítőnek lehet majd jó a lehetőség. Ennek ellenére az Nvidia csak nyerhet a támogatással. A GTX kártyákat tulajdonosaira ugyanis kedvcsinálóként is hathat a támogatás, az újabb, RTX kártyák felé terelve azokat. A DirectX Raytracing szélesebb körű támogatáshoz fejlesztett meghajtóprogram megjelenését áprilisra ígéri az Nvidia.

Minden ami GPU-s

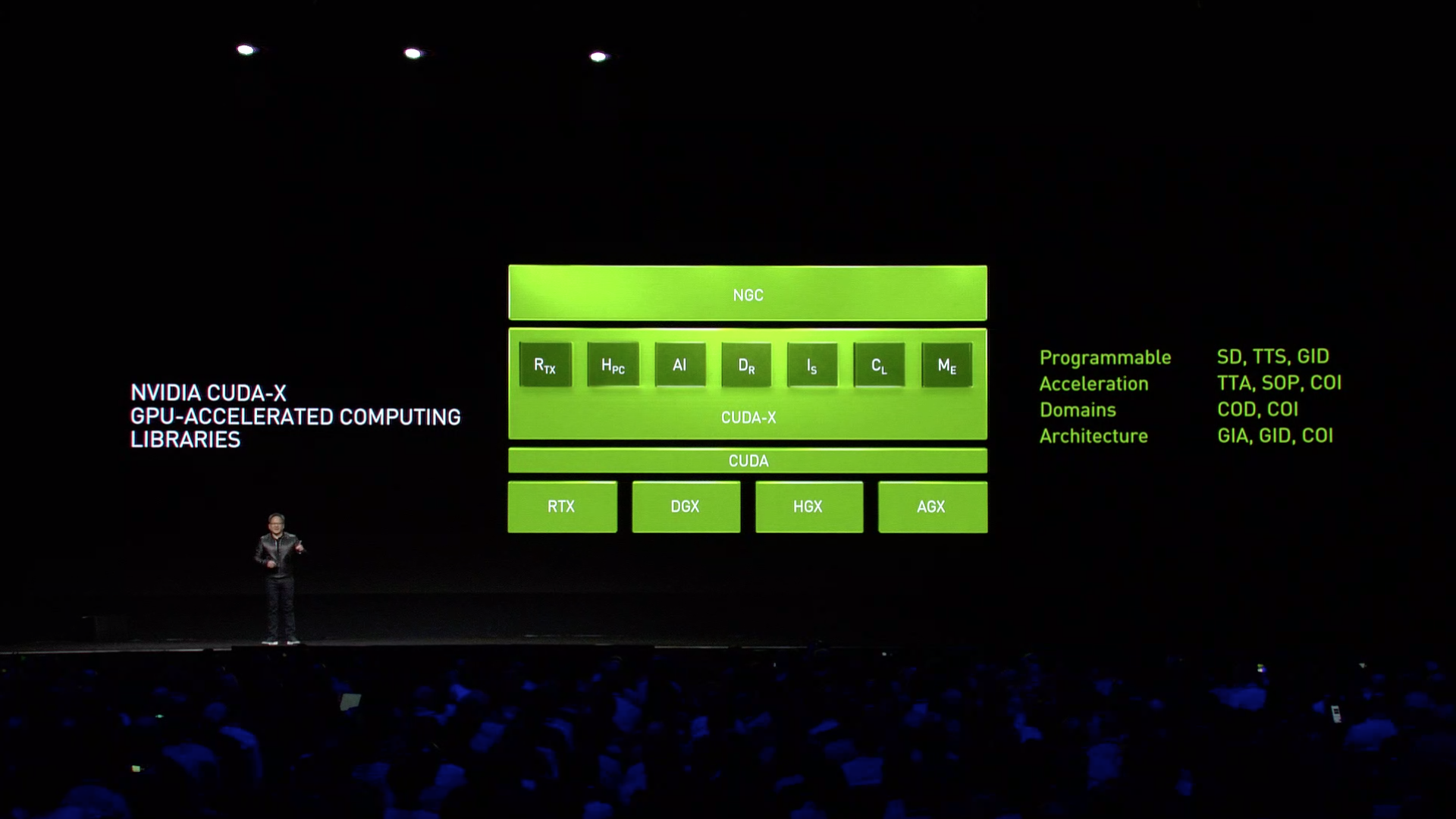

A keynote előadás nagy része a GPU-s gyorsításról, illetve az ahhoz köthető szoftverekről és hardverekről szólt. Nyitány gyanánt a vállalatot irányító Jensen Huang bejelentette, hogy a jövőben egyszerűbb lesz a GPU-s gyorsításhoz kínált szoftverek elnevezése. Az erre létrehozott CUDA-X márkanév gyűjti csokorba a különféle computing könyvtárakat, mellyel az Nvidia szerint egy konténer barátabb, a fejlesztők számára elérhetőbb csomag jön létre. Ez a tervezőcég azon távolra visszanyúló törekvésének újabb epizódja, mely kvázi minden munkafolyamatot GPU-val gyorsítana. A kezdeményezés legújabb jelszava a PRADA (Programmable Acceleration of multiple Domains with one Architecture).

8 erős érv a friss AI Engineering alapjai képzésünk mellett Összefoglaltuk röviden, hogy miért érdemes részt venni a május 26-án induló online tanfolyamon.

A tervezőcég ez alá sorolja be az RTX-et, azaz a már említett ray tracinges grafikát is, amit játékok mellett professzionális célokra, például valósághűbb modellezésre is lehet használni. Az Nvidia a tavaly elindított új, továbbra is gyerekcipőben járó iránya egyre jobb támogatottságot kap. Ehhez kapcsolódik, hogy az Unreal Engine, illetve a Unity motorok is ray tracing támogatással gazdagodnak, amely a két fejlesztés népszerűségét tekintve jó hír az Nvidia, illetve a (natív) ray tracing támogatással rendelkező GPU-k tulajdonosai számára. Ezek mellett számos professzionális alkalmazáshoz is DXR/RTX támogatást ígér az Nvidia. Konkrét címekről nem beszélt a cég, de a listán többek között olyan szoftverházak vannak mint az Adobe vagy az Autodesk.

Szintén a grafikai gyorsításhoz kapcsolódik a GeForce Now, vagyis az Nvidia játékstreaming megoldása. A koncepció lényege, hogy a játékok nem a végfelhasználónál lévő hardveren futnak, hanem a vállalat szerverein, ahonnan a játékosok gyakorlatilag csak a kép- és hanganyagot streamelik, mindezt előfizetési díj ellenében. A megoldás nagy előnye, hogy használatával a felhasználóknak nincs szükségük erős hardverre, gyakorlatilag egy kontroller, illetve egy a beérkező videóval megbirkózni képes kliens birtokában már játszhatnak is - természetesen megfelelő internetkapcsolat mellet.

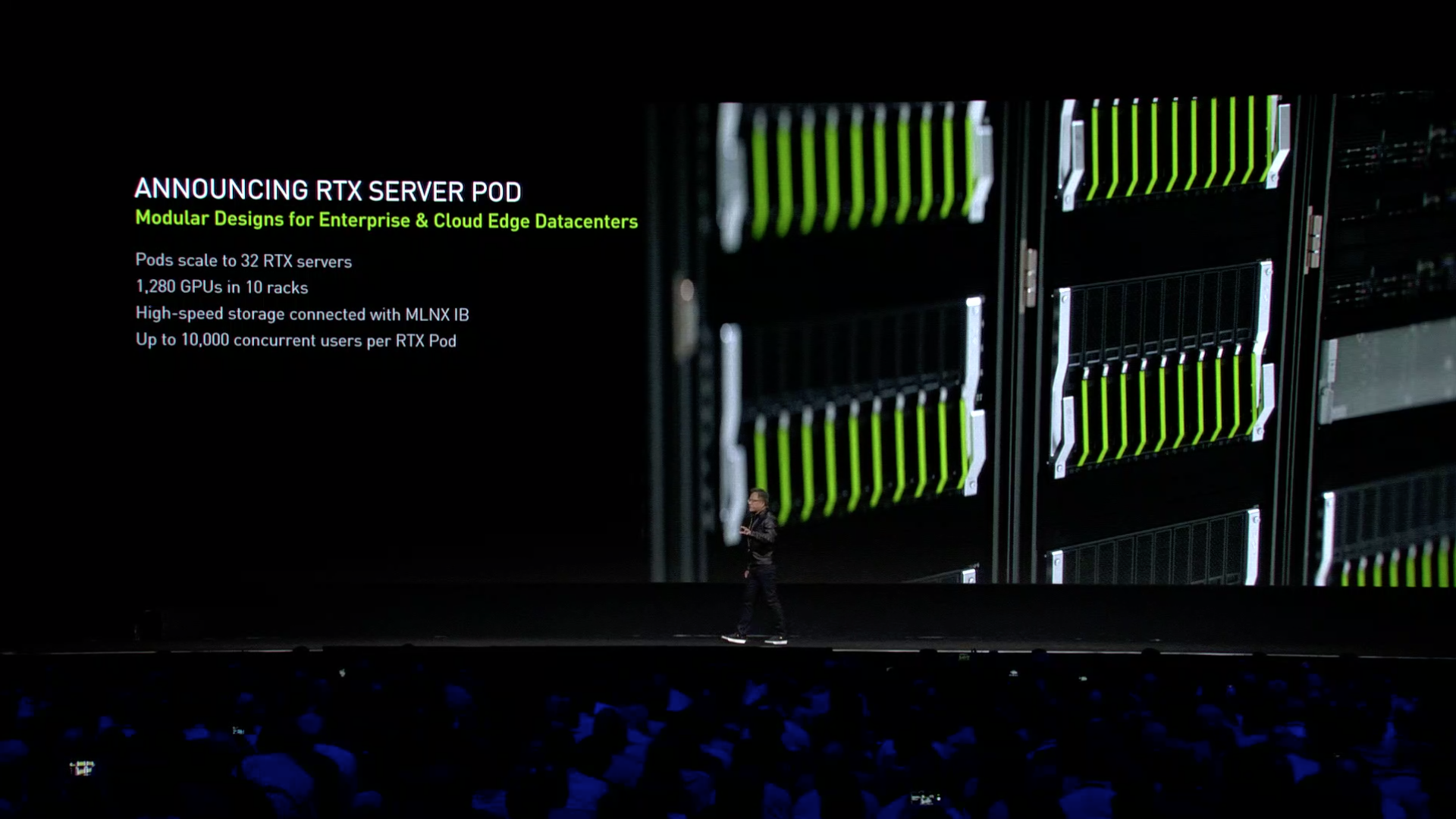

Bár a GeForce Now egyelőre nem nevezhető sikertörténetnek, a vállalat folyamatosan fejleszti szolgáltatását. Ehhez már egy szövetség is létrejött, mellyel az Nvidia telkókkal fog össze. Az együttműködés lényege, hogy a számításokat végző szerverek a szolgáltatók hálózatában vannak, közel(ebb) a felhasználókhoz, csökkentve a játékélmény szempontjából kritikus késleltetést. Első körben a japán SoftBankkal és a dél-koreai LG U+ szolgáltatóval kooperál a tervezőcég, ezek adatközpontjaiba költöznek be speciális RTX szerverek. Az Nvidia által tervezett 8U kiszolgálóban 40 darab Turing GPU lapul, amelynek számítási kapacitása egyidőben akár 320 felhasználót is képes kiszolgálni. A szerverekből összesen legfeljebb 32 darab rendezhető egybe az InfiniBand interkonnekttel egy úgynevezett RTX Server Podba, amely összesen 1280 darab GPU-jával akár 10 000 konkurens felhasználót is képes kiszolgálni.

Természetesen nem maradhatott ki az Nvidia saját tervezésű kiszolgálói által (is) futtatott másik, manapság egyre népszerűbb munkafolyamat, a csak AI néven emlegetett gépi tanulás sem. Ehhez kapcsolódóan a tervezőcég bejelentette, hogy a vegyes pontosságú végrehajtás már TensorFlow, PyTorch, illetve MXNet esetében is elérhető. Ennek hála egyes esetekben gyorsítható a végrehajtás, hisz bizonyos algoritmusok megelégszenek alacsonyabb (pl. INT4) pontosságú végrehajtással is, amelyet az azt támogató GPU-k képesek rövidebb idő alatt lefuttatni. Egy új toolkitet is bejelentett a cég. A Clara egy nyílt, skálázható compute platform egészségügyi, pontosabban elsősorban radiológiai felhasználáshoz. A toolkit 13 előre tréningelt modellt tartalmaz, amelyre építve automatizált munkafolyamatok hozhatóak létre.

Többek között az ilyen fejlesztői munkához kínál majd néhány OEM-mel karöltve "Data Science Workstation" munkaállomásokat az Nvidia. A legerősebb konfiguráció két Quadro RTX 8000-et tartalmaz ismeretlen, vélhetően sokmagos processzorral és 96 gigabájt rendszermemóriával. Az asztali rendszer előtelepítetten kínálja majd a CUDA-X csomagot a TensorFlow, PyTorch, Caffe, illetve RAPIDS szoftverekkel. Amely fejlesztő (vagy adattudós) nem szeretné megvásárolni a várhatóan igencsak költséges konfigurációt, annak továbbra is ott lesz opcióként a felhő. Ehhez kapcsolódóan az Nvidia és az Amazon bejelentette, hogy az AWS-ben immár elérhető a G4 instance, melyben a chiptervező Tesla T4 gyorsítóinak képességeit lehet kiaknázni.

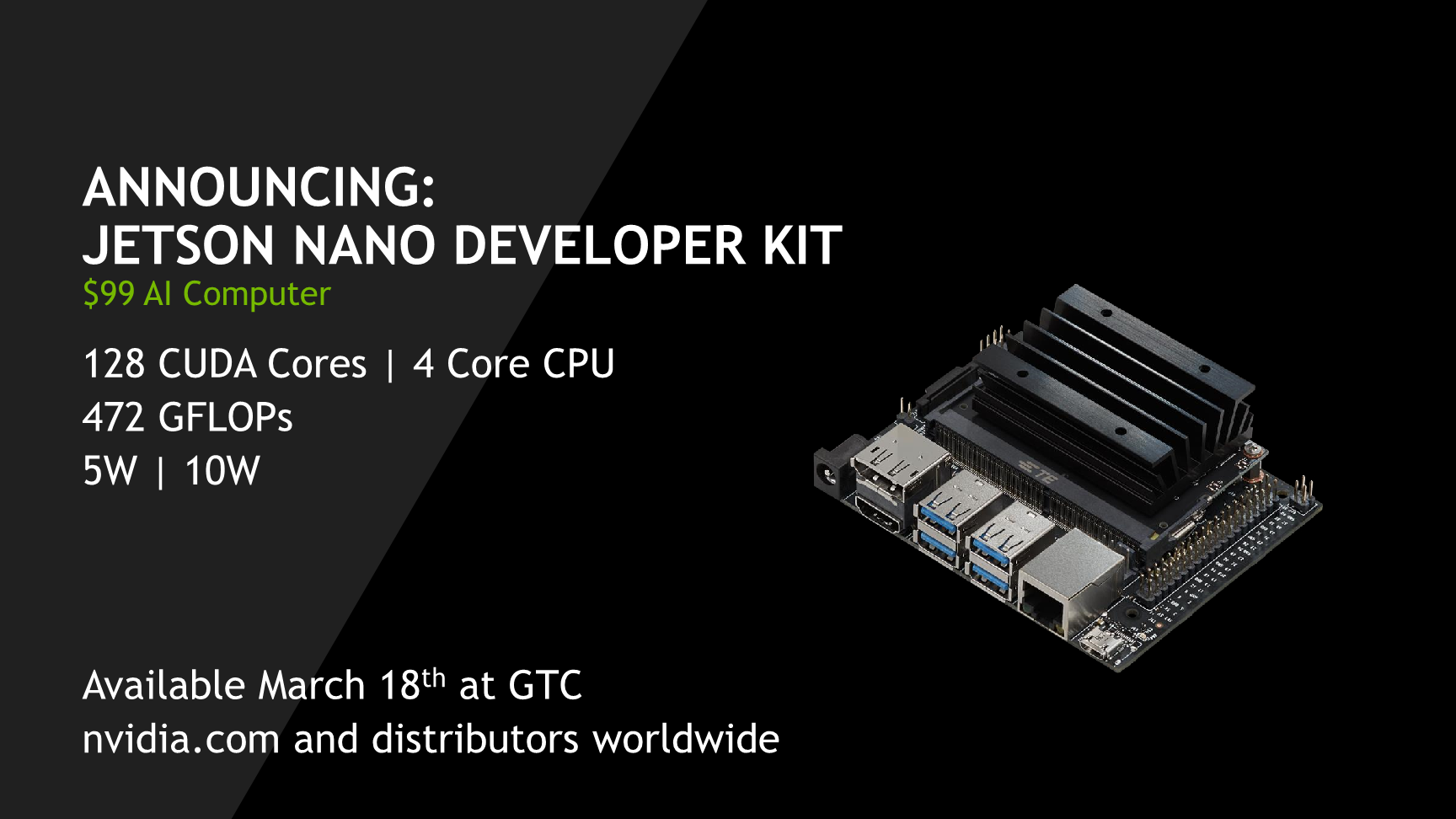

A legkisebb Jetson

Végül, de nem utolsó sorban Jetson fejlesztői platformjának legújabb tagját is bemutatta az Nvidia. A Jetson Nano az Nvidia "Erista" lapkájára épít, mely négy ARM Cortex-A57 magot és 128 Maxwell végrehajtót tartalmaz 4 gigabájt LPDDR4 memória társaságában, a háttértár szerepét pedig egy 16 gigabájtos eMMC egység (vagy microSD) töltheti be. A mindössze 70x45 milliméteres platform 472 GFLOPS-os számítási tempót ígér félpontosságú műveletek végrehajtásánál. A fejlesztői platform négy USB portot, MIPI-CSI, GPIO, I2C, I2S, SPI, UART interfészeket, gigabites Ethernetet, illetve HDMI 2.0 és eDP 1.4 kijelzőcsatolókat kínál.

Számítási teljesítményben a Jetson Nano bőven alulmarad a család többi tagjához képest, ezt az eddigieknél sokkal barátságosabb árral kompenzálja az Nvidia, amely legújabb fejlesztői platformjáért mindössze 99 dollárt kér. Bár az összeg többszöröse például a Raspberry Pi 3 Model B+ árának, ezért cserébe egy lényegesen erősebb GPU-val szerelt processzort kínál az Nvidia, amely akár alapszintű gépi tanulásos végrehajtáshoz is használható.