Beszáll a nagyvállalati AI gyorsítók piacára a Qualcomm

Saját tervezésű kártyákkal próbál betörni a nagyvállalati AI gyorsítók piacára a Qualcomm. A Centriq processzorokkal egyszer már elbukott a tervezőcég adatközpontos próbálkozása, és várhatóan az újabb roham sem lesz sétagalopp.

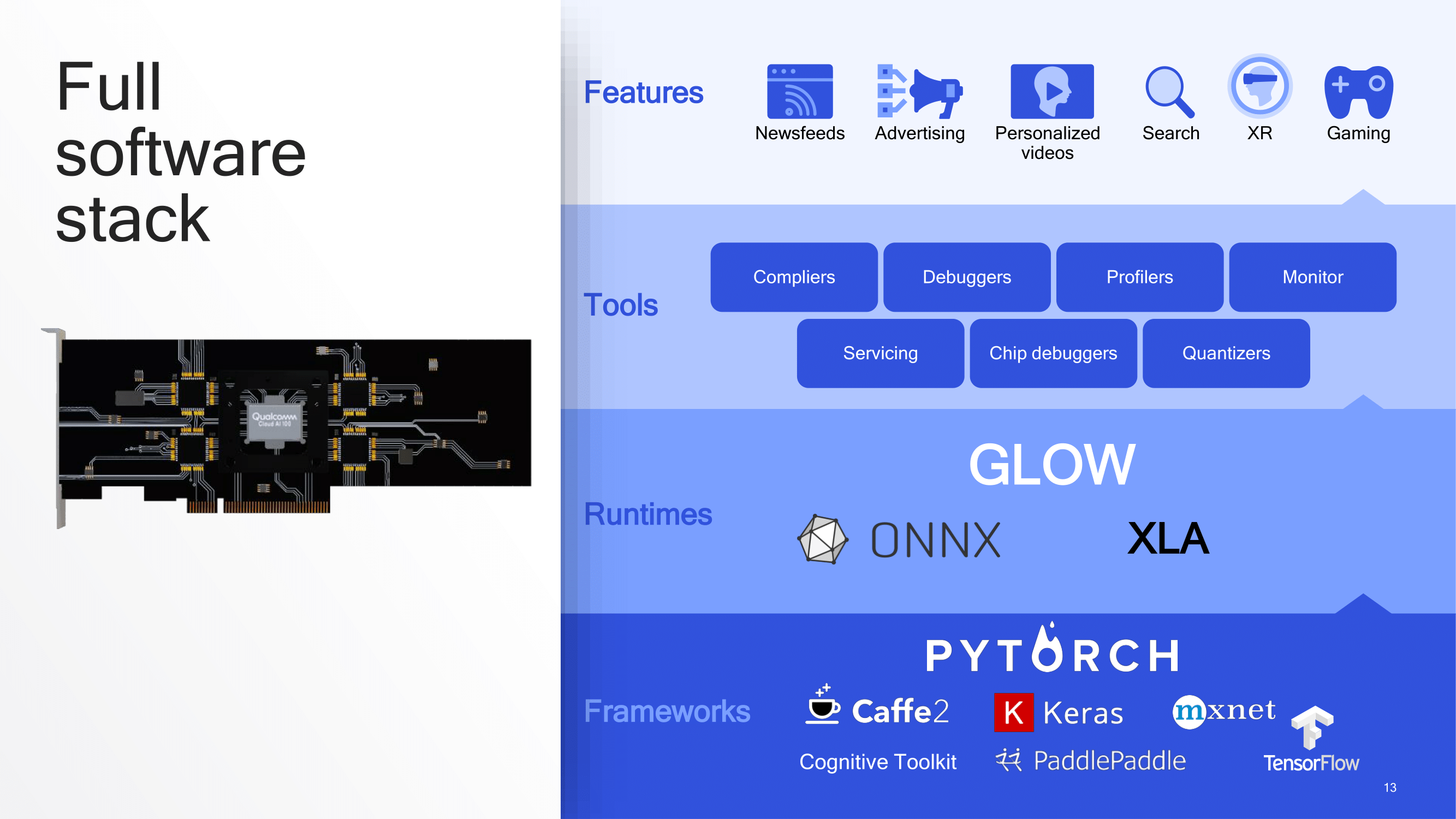

A Cloud AI 100 termékcsaládot a következtetéses (inferences) munkafolyamatokhoz szánja a tervezőcég. A hardver mellé software stack és készül, amely az ígéret szerint az összes népszerű frameworkot támogatja majd, beleértve TensorFlow-t, Caffe2-t, illetve a Kerast is. A Qualcomm feltett szándéka, hogy versenyre keljen a gyorsítós piacon brillírozó Nvidiával, illetve az ugyancsak komoly erőbedobássokkal készülő Intellel. A tervek szerint a Cloud AI 100 első tagja már jövőre, azaz 2020-ban piacra kerülhet.

A Qualcomm egyelőre nem osztott meg mélyebb technikai információkat fejlesztéséről, mindössze annyit tudni, hogy az egy ASIC-ra, vagyis egy alkalmazásspecifikus áramkörre épül. Ez a tervezési megközelítés egyik véglete, hisz bár az ilyen típusú áramkörök számítási teljesítményben és hatékonyságban egyaránt kimagaslóak, cserébe (például az FPGA-khoz képest) kevésbé rugalmasak, így bizonyos esetekben korlátok közé szoríthatják a fejlesztőket. Nem csoda, hogy a tervezőcég már most a hatékonyságot emeli ki, amely az ígéret szerint a jelenleg piacon lévő GPU-khoz és FPGA-khoz képest kimagasló lesz. Ehhez persze nagyban hozzájárul majd az élvonalbeli gyártástechnológia is, a lapka ugyanis a TSMC 7 nanométeres HPC eljárásával készül majd.

A mikroarchitektúrát tekintve nem kell a szomszédba mennie a Qualcommnak, a tervezőcég Snapdragon processzoraiban ugyanis már több generáció óta ott van a Hexagon DSP. A dedikált áramköri egység a HVX (Hexagon Vector Extensions) SIMD-re épít, amely 8 bitestől akár 1024 bit széles vektorokkal is operálhat. Ennek képességeit a közelmúltig leginkább csak videó- és képfeldolgozáshoz használták, azonban a kor hívószavának megfelelően már AI-jal kapcsolatos műveletek gyorsítására is be lehet fogni az egységet. Ez alapján nem lenne meglepő, ha a Cloud AI 100 is a HVX SIMD-re alapozna, ezt gyúrhatja át és skálázhatja feljebb a Qualcomm. Az ígéret szerint gépi tanulásos inference műveletek végrehajtásánál a dedikált gyorsító a Snapdragon 855-nél nagyjából 17-szer lehet majd gyorsabb.

Az IT munkaerőpiac kilábalása állandó délibáb lett Túl sok, számos esetben ellentétes hatás éri az IT munkaerőpiacot, a kínálati piac a béreket, a költséges AI pedig a headcountot eszi.

A vállalat ambícióit az táplálhatja, hogy a Tractica prognózisa alapján 2025-re egy 17 milliárd dollárosra hízhat az inferencing gyorsítók piaca. Ezzel párhuzamosan persze a verseny is élesedhet, hisz minden bizonnyal nem a Qualcomm az utolsó cég, amely beszáll a piacra. Az Nvidia Tesla gyorsítói már most rendkívül népszerűek, miközben az Intel két oldalról, FPGA-kkal és az ugyancsak 2020-ra datált új GPU-kkal egyaránt igyekszik majd piacit nyerni. Szintén említésre érdemes a Google, amely évek óta alkalmazza saját, TPU névre keresztelt fejlesztését. Bár a vállalat ezt nem értékesíti, saját igényeinek egy jelentős részét képes kiszolgálni vele.

A Qualcomm számára tehát várhatóan nem lesz sétagalopp a nagyvállalati gyorsítós piac sem. A tervezőcég egyszer már bepróbálkozott az adatközpontok világával, ám a Centriq processzorok mindmáig nem arattak sikert a potenciális partnerek körében. Tavaly nyáron már arról pletykáltak, hogy a projekten dolgozó igazgatók közül többen felálltak, amely a fejlesztés végét vetítette előre. Az azóta eltelt idő óta nem hallatott ARM-alapú szerverprocesszorairól a Qualcomm, így továbbra is bizonytalan a termékcsalád jövője.