Grandiózus gépi tanulásos chipet rakott össze a Cerebras

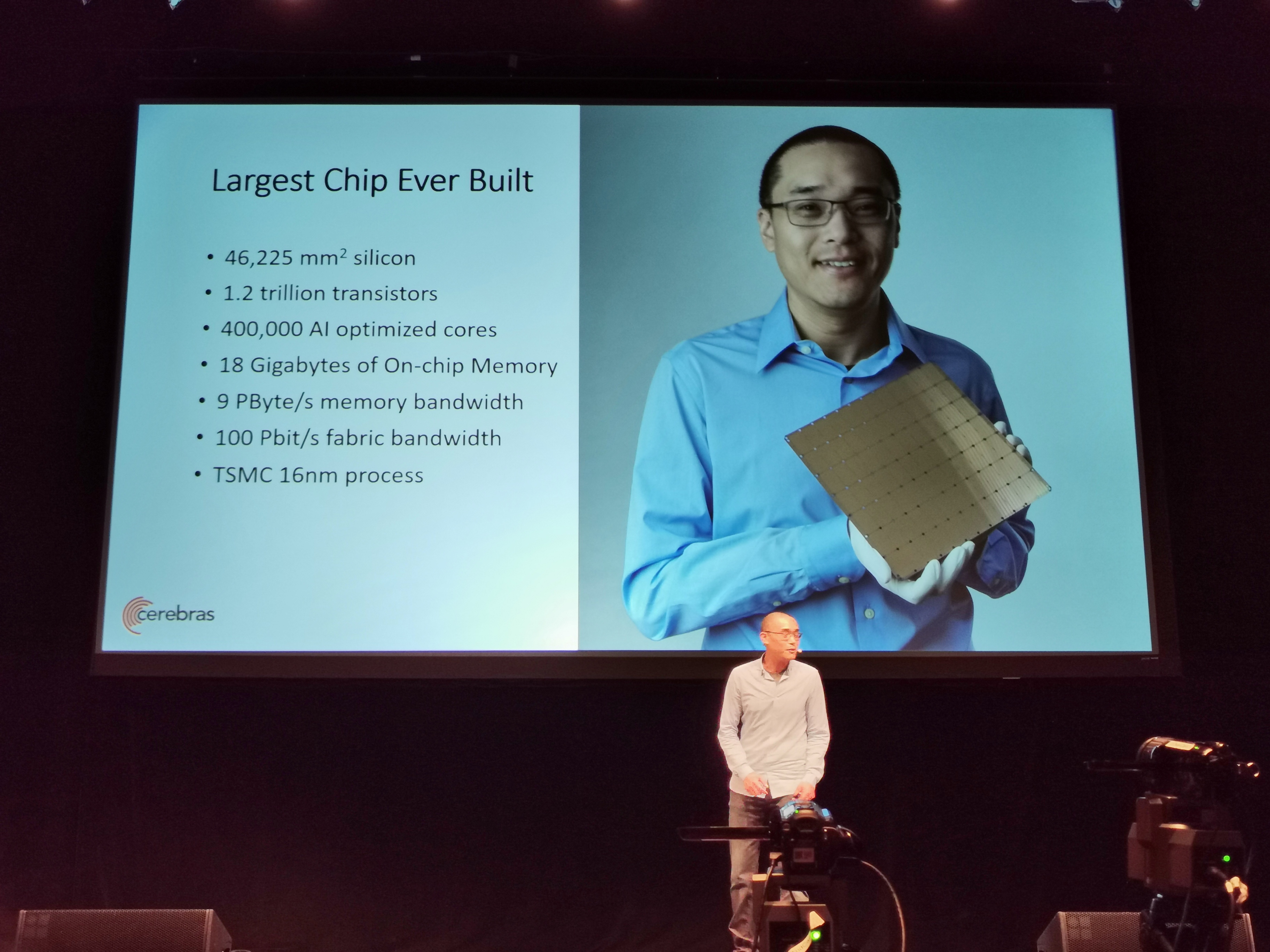

Rekordnagy, a sztenderd 300 milliméteres átmérőjű szilícium waferből kinyerhető legnagyobb, még egybefüggőnek tekinthető chippel robbant be a hírekbe a kaliforniai Cerebras. A gépi tanulásos fejlesztésekkel foglalkozó, mindössze 3 éves cég egy minden szempontból elképesztő dizájnt rakott össze.

A chip területe 46 225 mm2 (~462 cm2), amelyen 400 000 darab AI feldolgozásra optimalizált mag, illetve mintegy 18 gigabájt rendkívül gyors memória kapott helyet 1,2 billió tranzisztor formájában. Az elképesztő számok mögött egyedi fejlesztések sora áll, a grandiózus chip ugyanis komoly kihívás elé állította a Cerebrast és a bérgyártópartner TSMC-t. A tervezőcég szerint fejlesztésük új távlatokat nyithat a gépi tanulásos végrehajtásban, paramétereiből adódóan ugyanis akár egy komplett neurális hálót is futtathat a hatalmas chip.

A senior horizonton túl: a staff meg a többiek Senior tapasztalati szint fölött van még pár egzotikus lépcsőfok, illetve a mögöttük rejtőző elvárások.

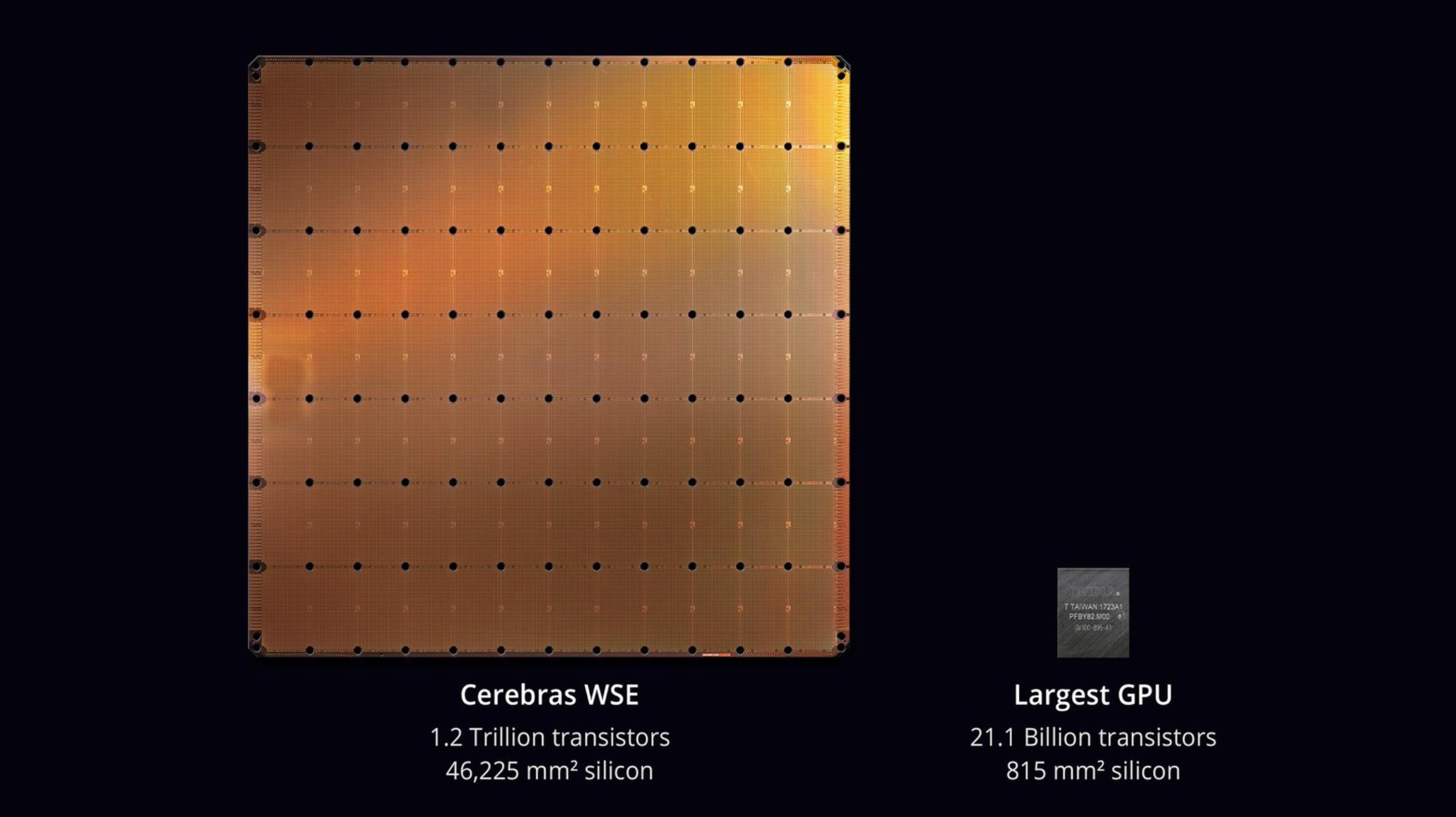

Az idei Hot Chips konferencián bemutatott wafer-scale fejlesztés tehát nagy ugrást ígér a gépi tanulásos végrehajtásban. Ehhez azonban számos kihívással kellett szembenéznie kvázi semmiből jött Cerebrasnak, amely a valaha épített legnagyobb chipet állította elő. A szó szoros értelmében hatalmas, mindkét oldalán 21,5 centiméter hosszú lap(ka) 56-szor nagyobb a jelenleg piacon lévő legnagyobb GPU-nak számító, 815 mm2-es Nvidia GV100-nál.

Hagyományos gyártási eljárással legfeljebb 858 mm2-es lapkát lehet előállítani a levilágítógépek limitációja miatt. Az iparágban sztenderdnek számító határvonalat a Cerebras egy sajátságos megközelítéssel lépte át. A 300 milliméteres átmérőjű waferből egyenlő hosszúságú oldalak mellett kinyerhető legnagyobb szilíciummal kalkuláltak a mérnökök, amelyre összesen 84 darab önálló áramkör került fel, darabonként 550 mm2-en. A csavart elsősorban az jelenti, hogy a szokványos eljárással szemben az egyes chipek végül a waferen maradnak, melyeket a határvonalat jelentő széleknél egy alacsony késleltetésű és magas sávszélességű fabric segítségével huzaloztak össze. Egy háló topológiával (mesh) összekapcsolt hatalmas, egybefüggő chip lett a végeredmény, amely a Cerebras szerint megoldást jelent a skálázódás problémájára, azaz lényegesen hatékonyabb a jelenleg alkalmazott, több különálló gyorsítókártyából (vagy chipből) összeállított rendszereknél.

Az egyes végrehajtók ugyanis nagyon közel vannak egymáshoz, ezért nem jelent szűk keresztmetszetet a folyamatos adatkommunikáció, illetve az esetlegesen lassú memória. Utóbbi ugyanis a chipbe integrálva kapott helyet SRAM formájában, mindössze 1 órajelciklusra a magoktól. A jellemzően elsősorban gyorsítótárakhoz alkalmazott statikus memóriából a Cerebras mérnökei összesen 18(!) gigabájtot helyeztek el a chipben, így nem is csoda, hogy az alacsony késleltetésű és magas sávszélességű memória emészti fel a szilícium nagy részét. Ez azonban rendkívül fontos, a klasszikus gyorsítókártyáknál ugyanis minden esetben valamilyen külső memóriába dolgoznak a magok, amely jelentősen növeli a késleltetést, több kártyás rendszereknél pedig a komplexitás is emelkedik.

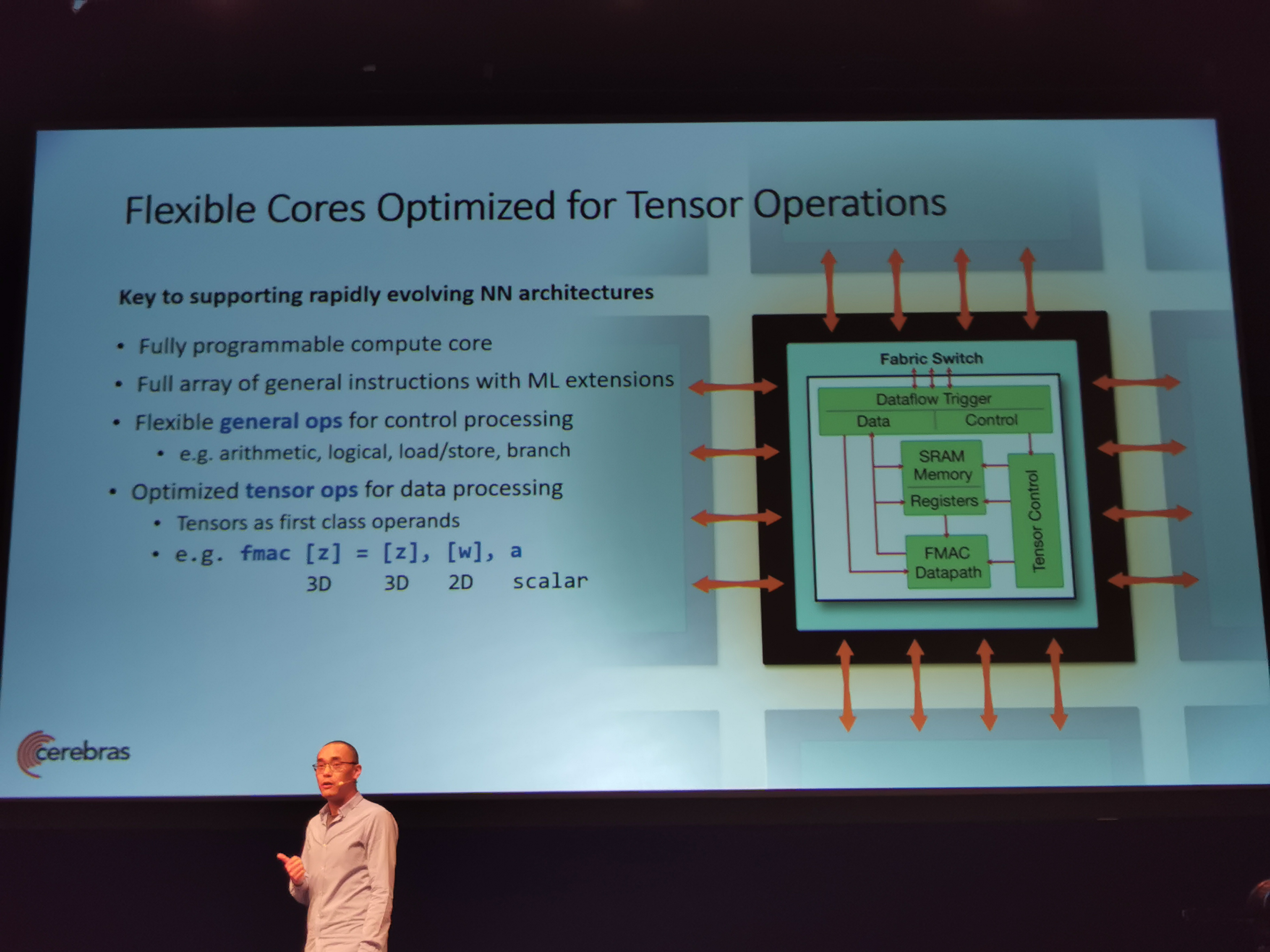

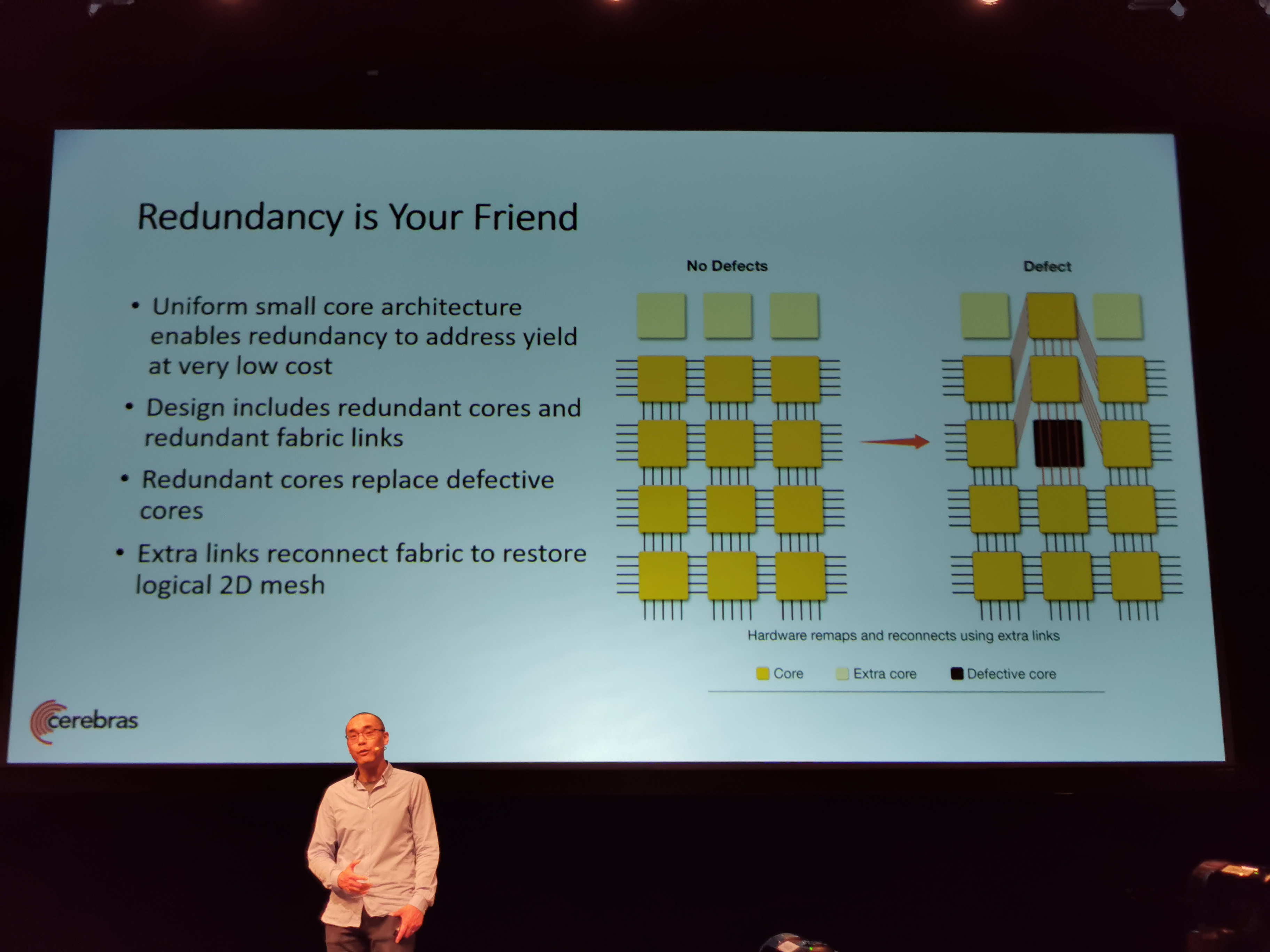

A fennmaradó hely többségét a végrehajtóegységek, azaz a magok foglalják el. Ezeket természetesen gépi tanulásos környezethez, a neurális hálóknál jellemző primitívekhez, pontosabban Tensor műveletekhez szabta a Cerebras, miközben az alapvető aritmetikai és logikai műveletek végrehajtása is támogatott. A magok az úgynevezett sparse processinget is támogatják, mely a gyorsabb végrehajtás érdekében képes kiszűrni a felesleges műveleteket, ritkítva a hálót. A magok tervezésénél fontos szempont volt a redundancia, a 462 cm2-es chipet ugyanis még a kiforrott, 16 nanométeres eljárással is lehetetlen hiba nélkül legyártani. A tervezők ezért extra magokat, illetve ezekhez kapcsolódóan további, az összeköttetéshez szükséges linkeket építettek be. Ez ugyanakkor a komplett chipre levetítve mindössze 1,5 százalékos többletet jelent, vagyis egyetlen önálló áramkör területénél is kevesebbet.

A Cerebras számára további kihívást jelentett a nagy méret (és tömeg), illetve a magas, egyelőre nem publikus disszipáció miatt a megfelelő tokozás elkészítése. A jelentősen eltérő hőtágulási mutatók okán a chip és a tokozás közé speciális áthidalást (connector) helyeztek, miközben a tápellátást is egyedi módon kellett megoldani, a disszipáció elvezetéséhez pedig nem is jöhetett szóba más, mint vízhűtés.

A készítők állítják, az egyedi chippel akár egy komplett racknyi GPU-s rendszer is kiváltható, amely a lényegesen kisebb helyigény mellett alacsonyabb fogyasztást, nem utolsó sorban pedig magasabb teljesítményt is jelent. Bár a chip konkrét számítási teljesítményéről, illetve (várhatóan több 1000 wattos) disszipációjáról még nem esett szó, akár egy vagy két nagyságrendű is lehet a gyorsulás neurális hálótól, valamint optimalizációtól függően. A Cerebras továbbá állítja, az első partnerek már élesben ismerkednek a fejlesztéssel, melynek teljesítményére vonatkozó konkrét paramétereket novemberben ismertetik.